Quando você digita algo em um chatbot de IA, provavelmente assume que a conversa fica entre você e a máquina. Você está enganado — e um novo estudo detalha exatamente quem mais está ouvindo.

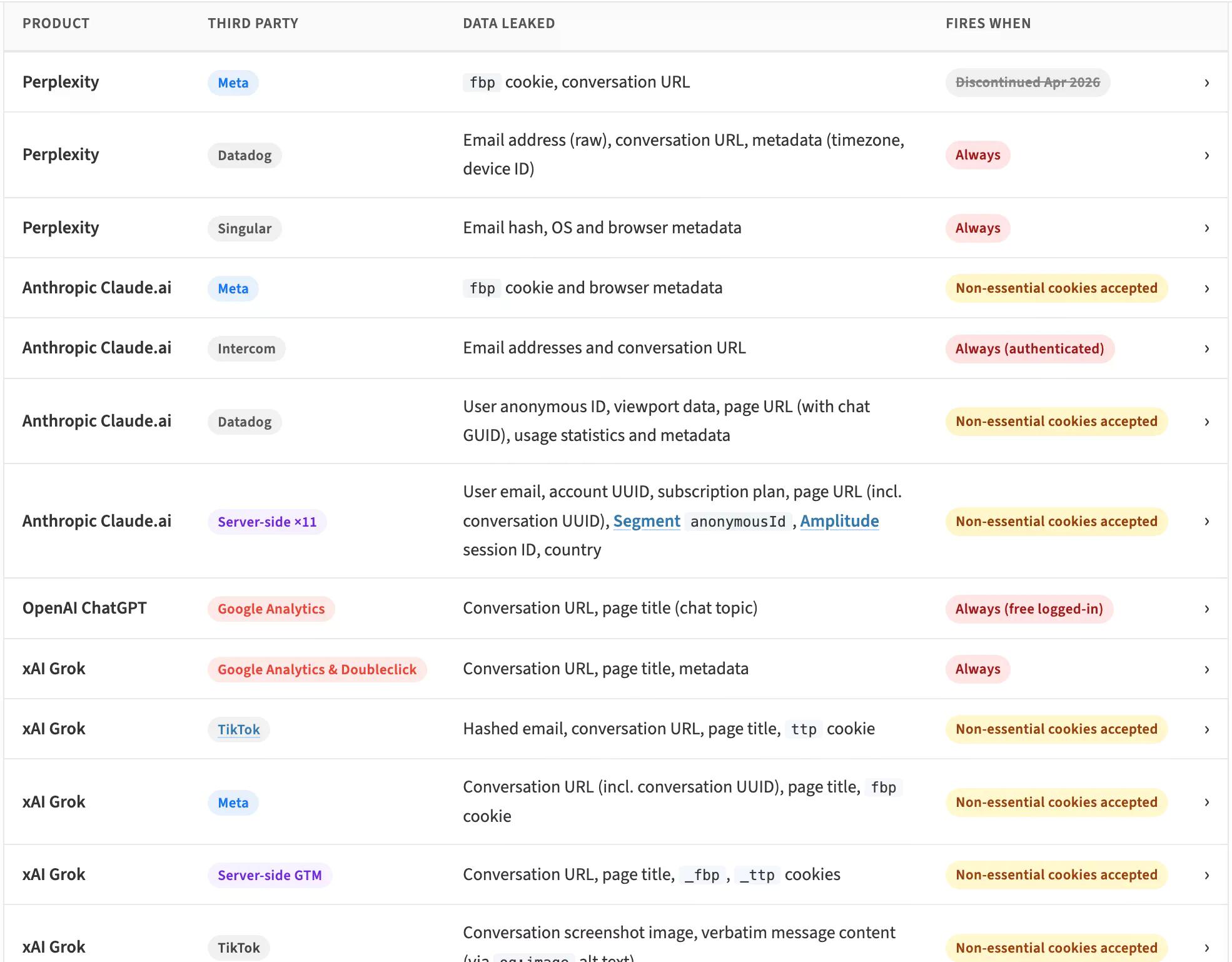

Pesquisadores do IMDEA Networks Institute publicaram descobertas em 4 de maio mostrando que todos os quatro maiores assistentes de IA — ChatGPT, Claude, Grok e Perplexity — compartilham dados discretamente com serviços de publicidade e análise de terceiros, incluindo Meta, Google e TikTok. O projeto, denominado LeakyLM, identificou mais de 13 rastreadores incorporados nessas plataformas. Nenhum deles é divulgado aos usuários em linguagem clara.

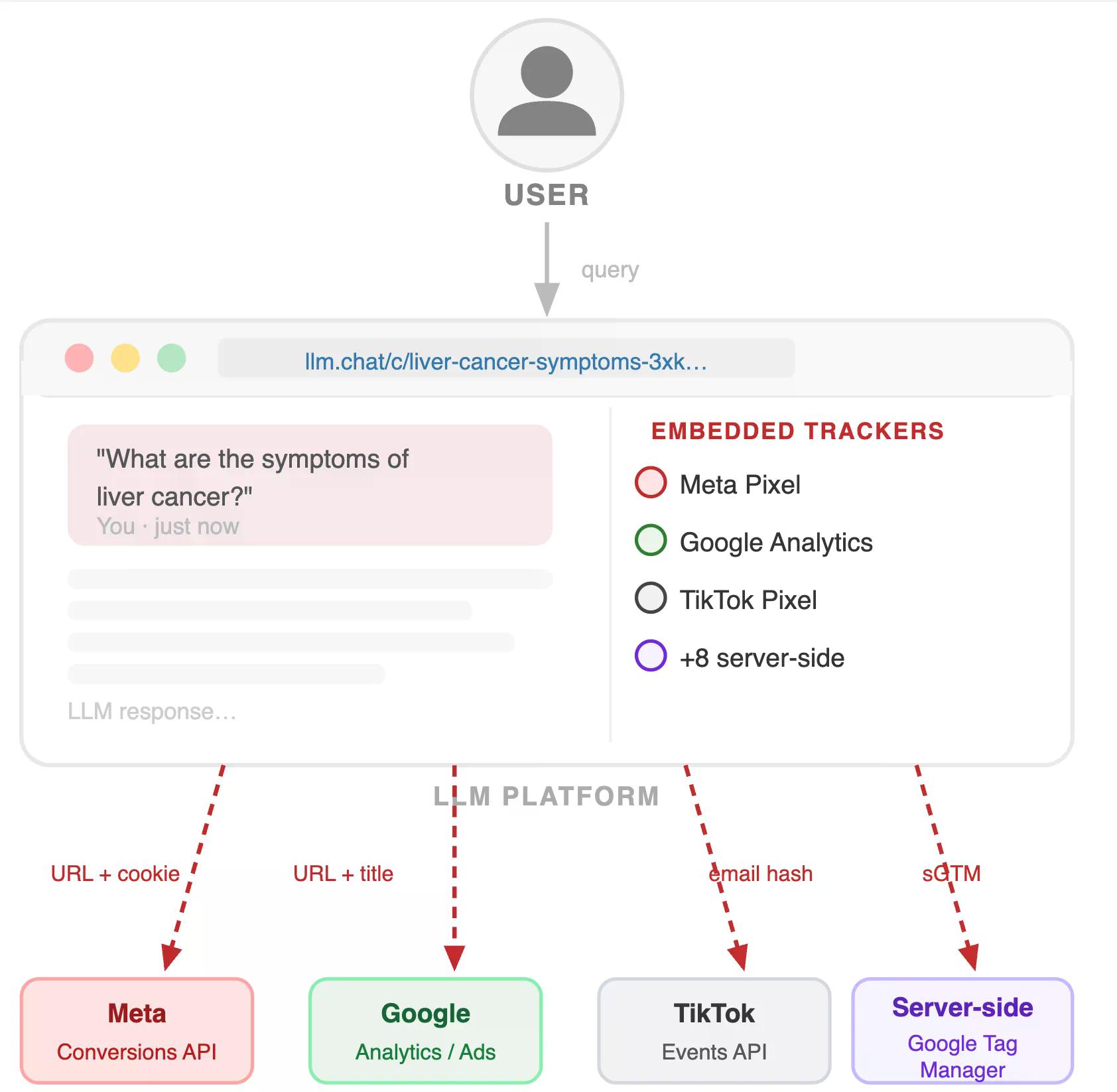

Pense assim: cada vez que você abre um chat, ferramentas de software invisíveis incorporadas na página da web enviam informações para redes de anúncios — enviando detalhes sobre quem você é, em que página você está e, às vezes, até o que você digitou.

O vazamento mais básico é o URL da sua conversa — um endereço web que aponta para um chat específico. Parece inofensivo, certo? O problema é que várias plataformas tornam esses URLs publicamente acessíveis por padrão, o que significa que qualquer pessoa que tenha o link pode ler sua conversa sem fazer login. Quando esses URLs também são enviados para os sistemas de anúncios da Meta ou do Google, essas empresas ganham a capacidade de acessar e ler seus chats.

"Vazar um URL não é apenas metadados — pode ser equivalente a vazar a própria conversa", dizem os pesquisadores.

Grok, o chatbot de IA de Elon Musk da xAI, é o mais exposto. As conversas de convidados são públicas por padrão na plataforma — não é necessário fazer login para lê-las. O rastreador do TikTok recebeu não apenas URLs, mas o conteúdo exato das mensagens através do que é chamado de metadados Open Graph, um padrão usado para gerar imagens de pré-visualização ao compartilhar um link. Basicamente, o sistema do TikTok recebeu uma captura de tela da sua conversa.

Claude (Anthropic) e ChatGPT (OpenAI) possuem controles de acesso mais rigorosos — seus chats não são públicos, a menos que você escolha compartilhá-los. Mas eles ainda transmitem URLs de conversas e dados de identificação, como cookies de publicidade, para Meta e Google. Para o Claude, esses dados vão para 11 plataformas de publicidade através dos próprios servidores da Anthropic, e não pelo navegador, razão pela qual um bloqueador de anúncios não irá impedi-lo.

Perplexity removeu seu rastreador da Meta no mês passado.

O estudo reconhece que não provou que a Meta ou o Google realmente leem os chats de alguém. Mas a infraestrutura para isso existe, e os dados estão sendo transmitidos. "Os LLMs estudados oferecem controles de privacidade para limitar a visibilidade da conversa, mas podem enganar os usuários ao implicar proteções mais fortes do que as realmente aplicadas", argumentam os pesquisadores. "Embora ainda não tenhamos evidências de que as conversas sejam lidas por rastreadores, a disseminação de permalinks e, por extensão, a capacidade de lê-los existem, e, portanto, o risco potencial."

Esta não é a primeira vez que plataformas de IA enfrentam escrutínio em relação à privacidade. Claude recentemente começou a exigir verificação de identidade governamental para novos assinantes — uma medida que gerou reação dos mesmos usuários preocupados com a privacidade que haviam trocado o ChatGPT por preocupações com vigilância, conforme relatado pela Decrypt no mês passado.

Por enquanto, as medidas práticas são limitadas. No Grok, restrinja a visibilidade da conversa nas configurações e revogue explicitamente qualquer link que você já tenha compartilhado. No Claude, rejeitar cookies não essenciais pelo menos desativa o Meta Pixel. No Perplexity, defina as conversas como Privadas. No ChatGPT, rejeitar cookies sempre que possível reduz a exposição, embora o Google Analytics ainda funcione para usuários logados gratuitos.

Se você quiser ir ainda mais fundo e estar totalmente protegido, nosso guia sobre Privacidade de IA pode ser um bom recurso para consultar.

Os pesquisadores planeiam estender sua análise para Meta AI, Microsoft Copilot e Google Gemini — que foram excluídos desta rodada porque operam simultaneamente como provedores de IA e empresas de publicidade, tornando o modelo de ameaça mais complicado.

As descobertas foram submetidas às Autoridades de Proteção de Dados em 13 de abril de 2026. A xAI foi notificada em 17 de abril. Até o momento da publicação, nenhuma empresa respondeu.