Kiedy coś wpisujesz do chatbota AI, prawdopodobnie zakładasz, że rozmowa pozostaje między tobą a maszyną. Mylisz się — a nowe badanie dokładnie ujawnia, kto jeszcze słucha.

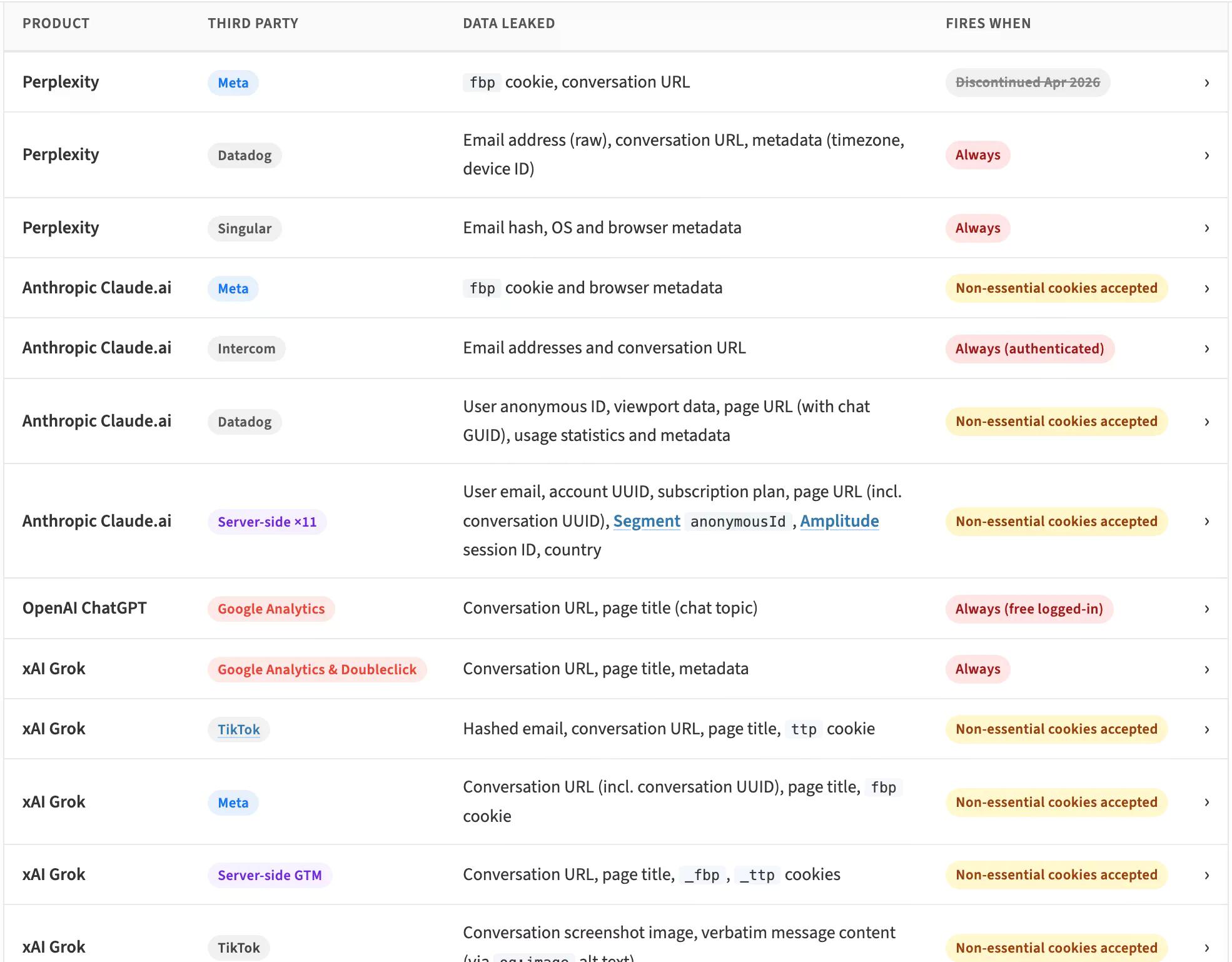

Naukowcy z IMDEA Networks Institute opublikowali 4 maja wyniki, które pokazują, że wszyscy czterej najwięksi asystenci AI — ChatGPT, Claude, Grok i Perplexity — po cichu udostępniają dane zewnętrznym usługom reklamowym i analitycznym, w tym Meta, Google i TikTok. Projekt, nazwany LeakyLM, zidentyfikował ponad 13 trackerów wbudowanych w te platformy. Żaden z nich nie jest ujawniany użytkownikom w prostym języku.

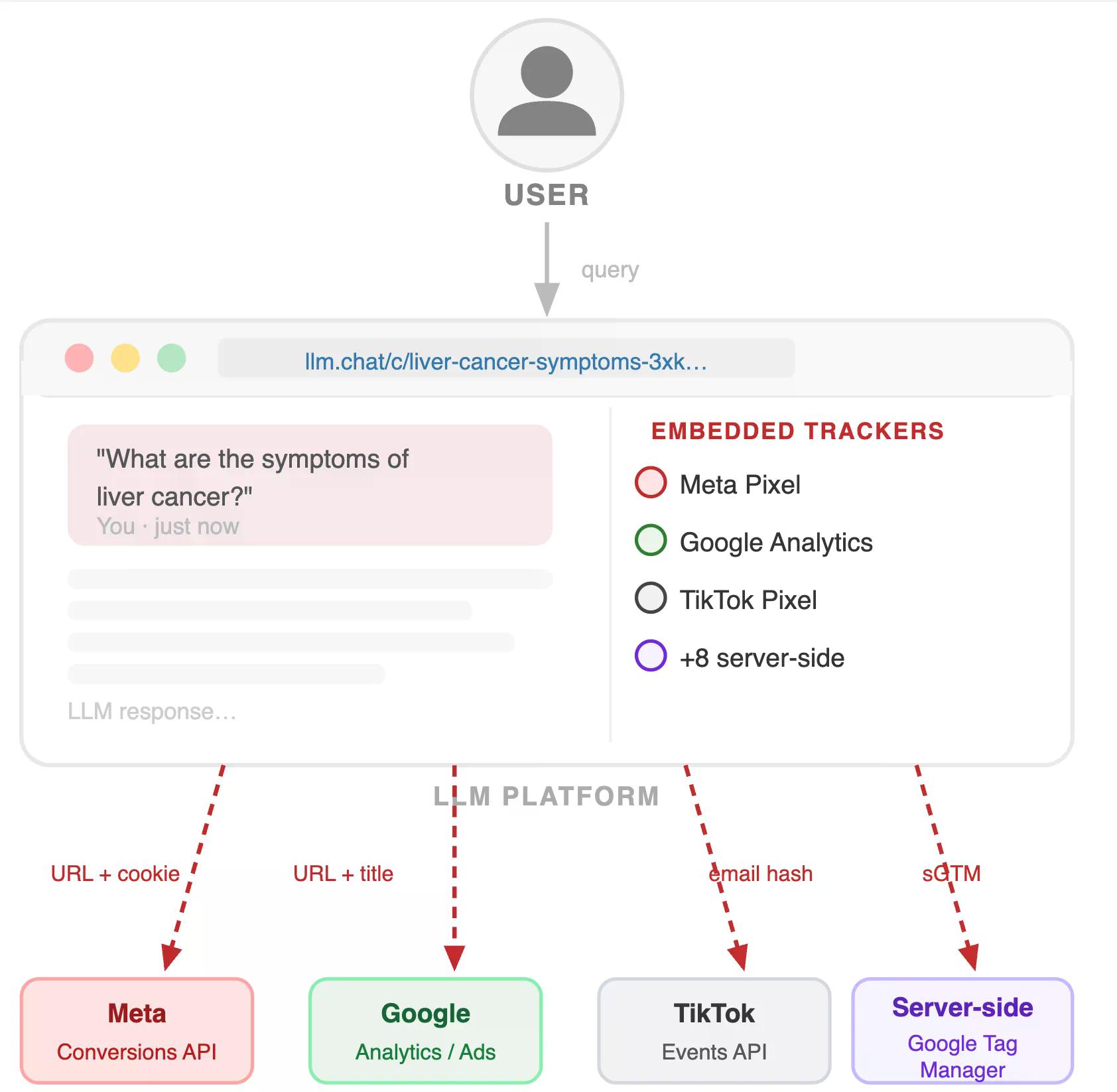

Pomyśl o tym w ten sposób: za każdym razem, gdy otwierasz czat, niewidzialne narzędzia programowe osadzone na stronie internetowej wysyłają dane do sieci reklamowych — przesyłając szczegóły o tym, kim jesteś, na jakiej stronie się znajdujesz, a czasem nawet, co wpisałeś.

Najbardziej podstawowym wyciekiem jest adres URL Twojej rozmowy — adres internetowy wskazujący na konkretny czat. Brzmi nieszkodliwie, prawda? Problem polega na tym, że kilka platform domyślnie udostępnia te adresy URL publicznie, co oznacza, że każdy, kto ma link, może przeczytać Twoją rozmowę bez logowania. Kiedy te adresy URL są również wysyłane do systemów reklamowych Meta lub Google, firmy te uzyskują możliwość dostępu do Twoich czatów i ich odczytywania.

„Wyciek adresu URL to nie tylko metadane — może być równoznaczne z wyciekiem samej rozmowy” — twierdzą naukowcy.

Grok, chatbot AI Elona Muska z xAI, jest najbardziej narażony. Rozmowy gości są domyślnie publiczne na platformie — do ich przeczytania nie jest wymagane logowanie. Tracker TikToka otrzymał nie tylko adresy URL, ale dosłowną treść wiadomości za pośrednictwem tak zwanych metadanych Open Graph, standardu używanego do generowania obrazów podglądu podczas udostępniania linku. Zasadniczo, system TikToka otrzymał zrzut ekranu z Twojej rozmowy.

Claude (Anthropic) i ChatGPT (OpenAI) mają silniejsze kontrole dostępu — Twoje czaty nie są publiczne, chyba że zdecydujesz się je udostępnić. Ale nadal przesyłają adresy URL rozmów i dane identyfikacyjne, takie jak pliki cookie reklamowe, do Meta i Google. W przypadku Claude'a dane te trafiają do 11 platform reklamowych za pośrednictwem serwerów Anthropic, a nie przez przeglądarkę, dlatego blokada reklam ich nie zatrzyma.

Perplexity usunęło swój tracker Meta w zeszłym miesiącu.

Badanie przyznaje, że nie udowodniono, iż Meta czy Google faktycznie czytają czyjeś czaty. Ale infrastruktura do tego istnieje, a dane są przesyłane. „Badane LLM-y oferują kontrole prywatności w celu ograniczenia widoczności rozmów, ale mogą wprowadzać użytkowników w błąd, sugerując silniejsze zabezpieczenia, niż są faktycznie egzekwowane” — argumentują naukowcy. „Chociaż nie mamy jeszcze dowodów na to, że rozmowy są odczytywane przez trackery, rozpowszechnianie trwałych linków, a co za tym idzie możliwość ich odczytywania, istnieje, a zatem istnieje potencjalne ryzyko”.

To nie pierwszy raz, kiedy platformy AI stają w obliczu kontroli w kwestii prywatności. Claude niedawno zaczął wymagać weryfikacji tożsamości za pomocą dokumentu rządowego od nowych subskrybentów — co spotkało się z protestem ze strony tych samych użytkowników dbających o prywatność, którzy przeszli z ChatGPT z powodu obaw o nadzór, jak donosił Decrypt w zeszłym miesiącu.

Na razie praktyczne kroki są ograniczone. W Grok ogranicz widoczność rozmów w ustawieniach i wyraźnie odwołaj wszelkie już udostępnione linki. W Claude odrzucenie nieistotnych plików cookie przynajmniej wyłącza Meta Pixel. W Perplexity ustaw rozmowy na Prywatne. W ChatGPT odrzucenie plików cookie, tam gdzie to możliwe, zmniejsza ekspozycję, choć Google Analytics nadal działa dla bezpłatnych, zalogowanych użytkowników.

Jeśli chcesz zagłębić się jeszcze bardziej i być w pełni chroniony, nasz przewodnik po Prywatności AI może być dobrym źródłem informacji.

Naukowcy planują rozszerzyć swoją analizę na Meta AI, Microsoft Copilot i Google Gemini — które zostały wykluczone z tej rundy, ponieważ działają jednocześnie jako dostawcy AI i firmy reklamowe, co komplikuje model zagrożenia.

Wyniki zostały przekazane organom ochrony danych 13 kwietnia 2026 r. xAI zostało powiadomione 17 kwietnia. Do czasu publikacji żadna firma nie odpowiedziała.