Uruchomienie modelu AI na własnym komputerze jest świetne – dopóki nie przestaje być.

Obietnicą jest prywatność, brak opłat subskrypcyjnych i żadnych danych opuszczających Twoją maszynę. Rzeczywistość dla większości ludzi to obserwowanie migającego kursora przez pięć sekund między zdaniami.

To wąskie gardło ma nazwę: szybkość wnioskowania. I nie ma to nic wspólnego z tym, jak inteligentny jest model. To problem sprzętowy. Standardowe modele AI generują tekst fragment po fragmencie – zwany tokenem – po jednym na raz. Sprzęt musi przesyłać miliardy parametrów z pamięci do jednostek obliczeniowych, aby wytworzyć każdy pojedynczy token. Jest to powolne z założenia. Na sprzęcie konsumenckim jest to męczące.

Obejście, po które sięga większość ludzi, to uruchamianie mniejszych, słabszych modeli – lub mocno skompresowanych wersji, zwanych modelami skwantyzowanymi, które poświęcają część jakości na rzecz szybkości. Żadne z tych rozwiązań nie jest idealne. Dostajesz coś, co działa, ale nie jest to model, którego naprawdę chciałeś.

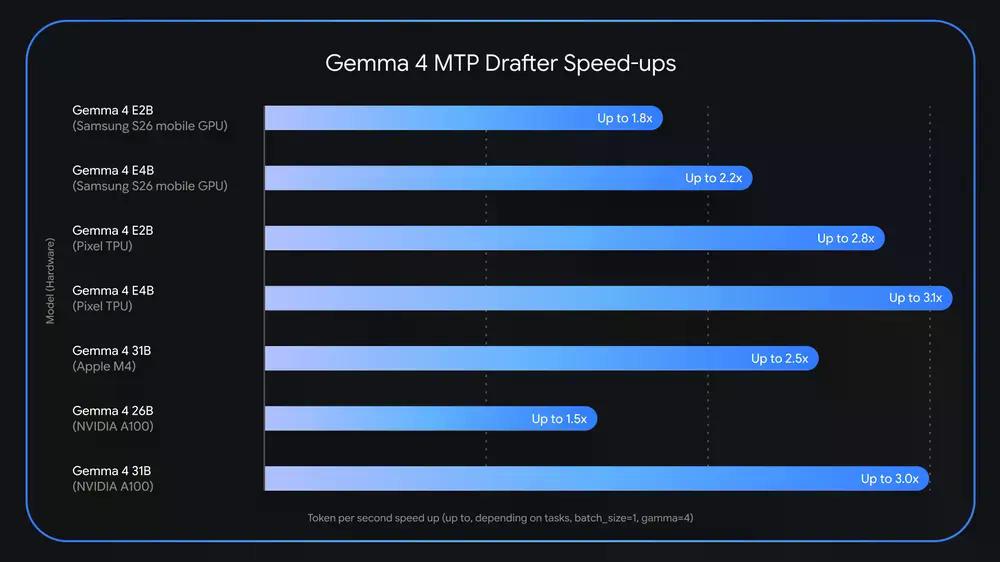

Teraz Google ma inny pomysł. Firma właśnie udostępniła narzędzia Multi-Token Prediction (MTP) dla swojej rodziny otwartych modeli Gemma 4 – technikę, która może zapewnić do 3-krotnego przyspieszenia bez naruszania jakości modelu ani jego zdolności rozumowania.

Podejście to nazywa się dekodowaniem spekulatywnym i istnieje jako koncepcja od lat. Naukowcy z Google opublikowali fundamentalny artykuł w 2022 roku. Pomysł nie stał się powszechny aż do teraz, ponieważ wymagał odpowiedniej architektury, aby działać na dużą skalę.

Oto krótka wersja tego, jak to działa. Zamiast zmuszać duży, potężny model do samodzielnej pracy, łączysz go z małym modelem "szkicującym". Model szkicujący jest szybki i tani – przewiduje kilka tokenów jednocześnie w krótszym czasie, niż główny model potrzebowałby na wyprodukowanie tylko jednego. Następnie duży model sprawdza wszystkie te przewidywania w jednym przebiegu. Jeśli przewidywania są poprawne, otrzymujesz całą sekwencję za cenę jednego przebiegu do przodu.

Według Google, "jeśli model docelowy zgadza się ze szkicem, akceptuje całą sekwencję w jednym przebiegu do przodu – i nawet generuje dodatkowy token w trakcie tego procesu".

Nic nie jest poświęcone: Duży model – na przykład gęsta wersja Gemma 4 31B – nadal weryfikuje każdy token, a jakość wyjściowa jest identyczna. Po prostu wykorzystujesz nieaktywną moc obliczeniową, która była niewykorzystana podczas wolnych etapów.

Google twierdzi, że modele szkicujące współdzielą pamięć podręczną KV modelu docelowego – strukturę pamięci, która przechowuje już przetworzony kontekst – dzięki czemu nie marnują czasu na ponowne obliczanie rzeczy, które większy model już zna. Dla mniejszych modeli brzegowych, przeznaczonych dla telefonów i urządzeń Raspberry Pi, zespół opracował nawet wydajną technikę klastrowania, aby jeszcze bardziej skrócić czas generowania.

To nie jedyna próba, jaką świat AI podjął w celu równoległego generowania tekstu. Dyfuzyjne modele językowe – takie jak Mercury z Inception Labs – próbowały zupełnie innego podejścia: zamiast przewidywać jeden token na raz, zaczynają od szumu i iteracyjnie dopracowują cały wynik. To jest szybkie na papierze, ale dyfuzyjne LLM-y miały trudności z dorównaniem jakością tradycyjnym modelom transformatorowym, pozostawiając je bardziej ciekawostką badawczą niż praktycznym narzędziem.

Dekodowanie spekulatywne jest inne, ponieważ wcale nie zmienia bazowego modelu. Jest to optymalizacja obsługi, a nie zamiana architektury. Ten sam model Gemma 4, który już uruchamiałeś, staje się szybszy.

Praktyczne korzyści są realne. Model Gemma 4 26B działający na komputerowej karcie graficznej Nvidia RTX Pro 6000 uzyskuje mniej więcej dwukrotnie więcej tokenów na sekundę z włączonym narzędziem MTP, zgodnie z własnymi testami porównawczymi Google. Na procesorach Apple Silicon, rozmiary partii od 4 do 8 żądań odblokowują około 2,2-krotne przyspieszenia. Nie jest to dokładnie 3-krotny limit w każdym scenariuszu, ale nadal znacząca różnica między "ledwo użytecznym" a "wystarczająco szybkim, by z nim pracować".

Kontekst ma tutaj znaczenie. Kiedy chiński model DeepSeek wstrząsnął rynkiem w styczniu 2025 roku – wymazując 600 miliardów dolarów z kapitalizacji rynkowej Nvidii w ciągu jednego dnia – główną lekcją było to, że wzrost efektywności może być bardziej dotkliwy niż surowa moc obliczeniowa. Działanie mądrzej jest lepsze niż rzucanie większej ilości sprzętu na problem. Narzędzie MTP Google to kolejny krok w tym kierunku, tyle że skierowany bezpośrednio do konsumenta końcowego.

Cała branża AI jest obecnie trójkątem, który obejmuje wnioskowanie, trenowanie i pamięć. Każdy przełom w jednej z tych dziedzin zazwyczaj wzmacnia lub szokuje cały ekosystem. Podejście DeepSeek do trenowania (osiągnięcie potężnych modeli na słabszym sprzęcie) było jednym przykładem, natomiast artykuł Google o TurboQuant (zmniejszenie pamięci AI bez utraty jakości) był kolejnym. Oba spowodowały załamanie rynków, gdy firmy próbowały rozgryźć, co robić.

Google twierdzi, że narzędzie odblokowuje "poprawioną responsywność: drastycznie zmniejsza opóźnienia w przypadku czatów w czasie zbliżonym do rzeczywistego, wciągających aplikacji głosowych i agentowych przepływów pracy" – rodzaj zadań, które wymagają niskich opóźnień, aby w ogóle być użytecznymi.

Przypadki użycia szybko stają się jasne: Lokalny asystent kodowania, który się nie zacina; interfejs głosowy, który odpowiada, zanim zapomnisz, o co pytałeś; agentowy przepływ pracy, który nie zmusza Cię do czekania trzech sekund między krokami. Wszystko to na sprzęcie, który już posiadasz.

Narzędzia MTP są już dostępne na Hugging Face, Kaggle i Ollama na licencji Apache 2.0. Działają od razu po wyjęciu z pudełka z vLLM, MLX, SGLang i Hugging Face Transformers.