هنگامی که چیزی را در یک ربات چت هوش مصنوعی تایپ میکنید، احتمالاً تصور میکنید که مکالمه بین شما و ماشین باقی میماند. اشتباه میکنید — و یک مطالعه جدید دقیقاً مشخص میکند که چه کسانی دیگر در حال گوش دادن هستند.

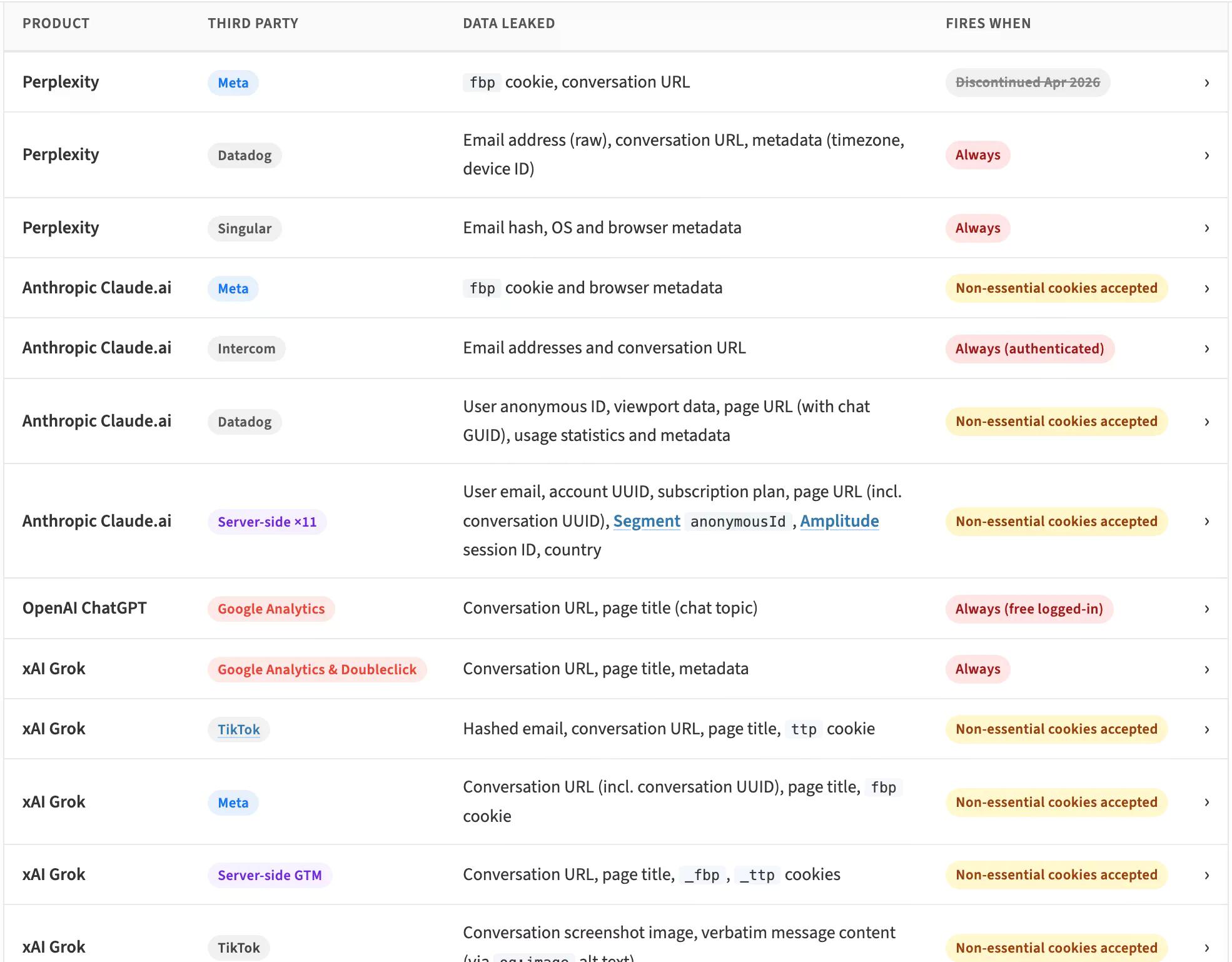

محققان در IMDEA Networks Institute در تاریخ ۴ می یافتههایی را منتشر کردند که نشان میدهد هر چهار دستیار بزرگ هوش مصنوعی—ChatGPT، Claude، Grok و Perplexity—به آرامی دادهها را با خدمات تبلیغاتی و تحلیلی شخص ثالث، از جمله متا، گوگل و تیکتاک به اشتراک میگذارند. این پروژه، که LeakyLM نام دارد، بیش از ۱۳ ردیاب جاسازی شده در این پلتفرمها را شناسایی کرد. هیچ یک از آنها به زبان ساده به کاربران افشا نمیشوند.

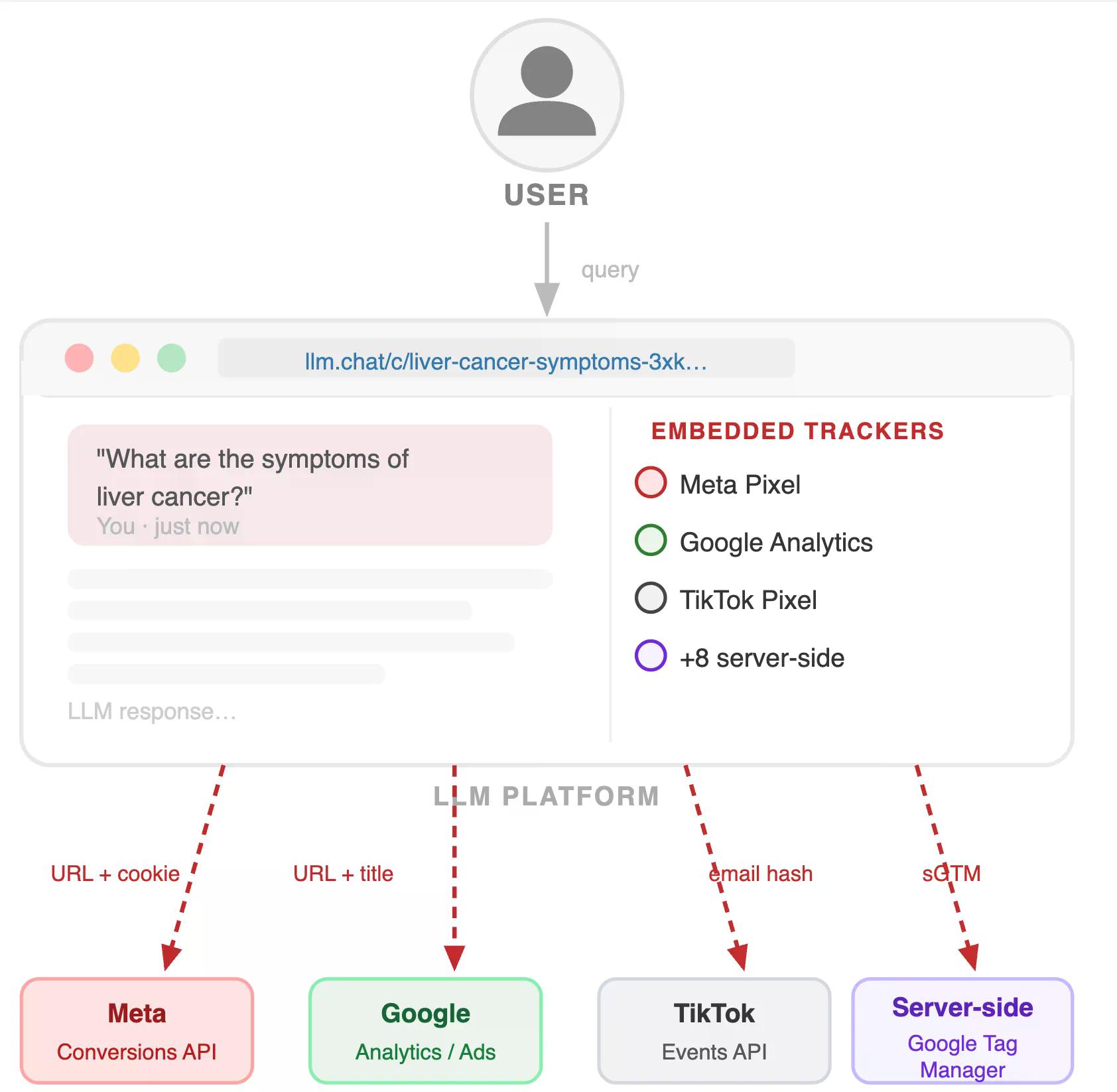

اینطور فکر کنید: هر بار که یک چت را باز میکنید، ابزارهای نرمافزاری نامرئی که در صفحه وب جاسازی شدهاند، به شبکههای تبلیغاتی گزارش میدهند – جزئیاتی درباره هویت شما، صفحهای که در آن هستید، و گاهی حتی آنچه را که تایپ کردهاید، ارسال میکنند.

ابتداییترین نشت، URL مکالمه شما است – یک آدرس وب که به یک چت خاص اشاره میکند. بیضرر به نظر میرسد، درست است؟ مشکل اینجاست که چندین پلتفرم این URLها را به طور پیشفرض عمومی میکنند، به این معنی که هر کسی که لینک را داشته باشد میتواند مکالمه شما را بدون ورود به سیستم بخواند. وقتی این URLها به سیستمهای تبلیغاتی متا یا گوگل نیز ارسال میشوند، آن شرکتها توانایی دسترسی و خواندن چتهای شما را پیدا میکنند.

محققان میگویند: "لو رفتن یک URL فقط فراداده نیست – میتواند معادل لو رفتن خود مکالمه باشد."

Grok، ربات چت هوش مصنوعی ایلان ماسک از xAI، بیشترین در معرض خطر قرار دارد. مکالمات مهمان به طور پیشفرض در این پلتفرم عمومی هستند – نیازی به ورود به سیستم برای خواندن آنها نیست. ردیاب تیکتاک نه تنها URLها بلکه محتوای کلمه به کلمه پیام را از طریق آنچه فراداده اوپن گراف نامیده میشود، دریافت میکرد؛ استانداردی که برای تولید تصاویر پیشنمایش هنگام اشتراکگذاری یک لینک استفاده میشود. اساساً، سیستم تیکتاک یک اسکرینشات از مکالمه شما را دریافت میکرد.

Claude (Anthropic) و ChatGPT (OpenAI) کنترلهای دسترسی قویتری دارند – چتهای شما عمومی نیستند مگر اینکه شما انتخاب کنید آنها را به اشتراک بگذارید. اما آنها همچنان URLهای مکالمه و دادههای شناسایی مانند کوکیهای تبلیغاتی را به متا و گوگل منتقل میکنند. برای Claude، این دادهها از طریق سرورهای خود Anthropic، و نه از طریق مرورگر، به ۱۱ پلتفرم تبلیغاتی ارسال میشوند، به همین دلیل یک مسدودکننده تبلیغات جلوی آن را نمیگیرد.

Perplexity ماه گذشته ردیاب متا خود را حذف کرد.

این مطالعه اذعان دارد که ثابت نکرده است که متا یا گوگل واقعاً چتهای کسی را میخوانند. اما زیرساخت لازم برای انجام این کار وجود دارد و دادهها در حال انتقال هستند. محققان استدلال میکنند: "LLMهای مورد مطالعه، کنترلهای حریم خصوصی را برای محدود کردن دیداری بودن مکالمه ارائه میدهند، اما ممکن است کاربران را با دلالت بر محافظتهای قویتر از آنچه واقعاً اعمال میشود، گمراه کنند." "در حالی که هنوز شواهدی نداریم که مکالمات توسط ردیابها خوانده میشوند، انتشار پیوندهای دائمی و در نتیجه قابلیت خواندن آنها وجود دارد، و بنابراین خطر بالقوه نیز هست."

این اولین بار نیست که پلتفرمهای هوش مصنوعی در زمینه حریم خصوصی مورد بررسی دقیق قرار میگیرند. همانطور که Decrypt ماه گذشته گزارش داد، Claude اخیراً برای مشترکین جدید احراز هویت با مدارک دولتی را الزامی کرده است – اقدامی که با واکنش منفی کاربران آگاه به حریم خصوصی روبرو شد، کاربرانی که به دلیل نگرانیهای نظارتی از ChatGPT به آن روی آورده بودند.

در حال حاضر، اقدامات عملی محدود است. در Grok، دیداری بودن مکالمه را در تنظیمات محدود کنید و صراحتاً هر پیوندی را که قبلاً به اشتراک گذاشتهاید لغو کنید. در Claude، رد کردن کوکیهای غیرضروری حداقل پیکسل متا را غیرفعال میکند. در Perplexity، مکالمات را خصوصی تنظیم کنید. در ChatGPT، رد کردن کوکیها در صورت امکان، میزان در معرض قرار گرفتن را کاهش میدهد، هرچند Google Analytics همچنان برای کاربران وارد شده رایگان فعال است.

اگر میخواهید عمیقتر شوید و کاملاً محافظت شوید، راهنمای ما درباره حریم خصوصی هوش مصنوعی ممکن است منبع خوبی برای بررسی باشد.

محققان قصد دارند تحلیل خود را به Meta AI، Microsoft Copilot و Google Gemini گسترش دهند – که در این دور از بررسی حذف شدند زیرا آنها همزمان هم ارائهدهندگان هوش مصنوعی و هم شرکتهای تبلیغاتی هستند، که مدل تهدید را پیچیدهتر میکند.

یافتهها در تاریخ ۱۳ آوریل ۲۰۲۶ به مقامات حفاظت از دادهها ارسال شد. xAI در ۱۷ آوریل مطلع شد. تا زمان انتشار، هیچ شرکتی پاسخ نداده است.