Cuando escribes algo en un chatbot de IA, probablemente asumes que la conversación se mantiene entre tú y la máquina. Estás equivocado, y un nuevo estudio detalla exactamente quién más está escuchando.

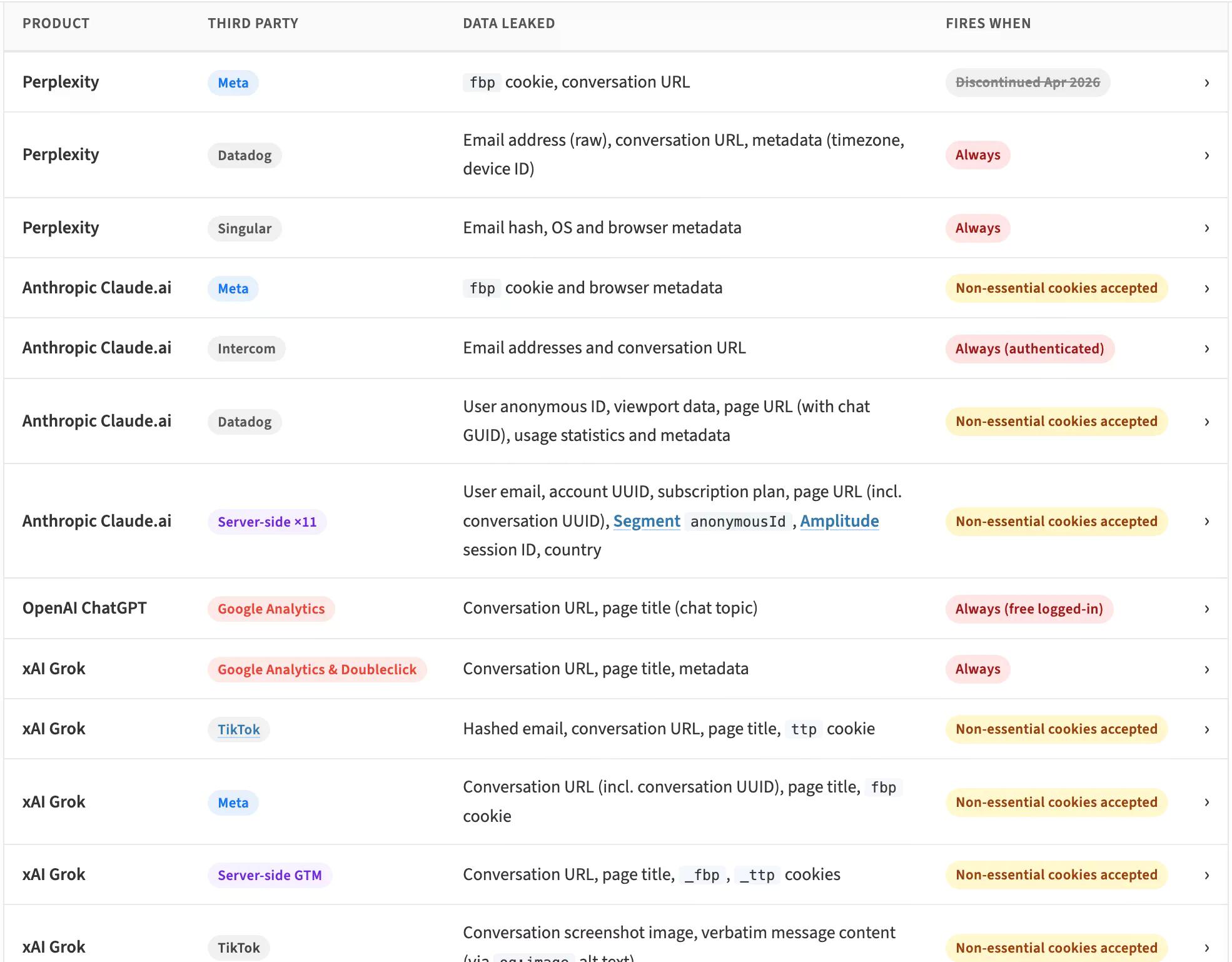

Investigadores del IMDEA Networks Institute publicaron hallazgos el 4 de mayo que muestran que los cuatro asistentes de IA más grandes —ChatGPT, Claude, Grok y Perplexity— comparten discretamente datos con servicios de publicidad y análisis de terceros, incluyendo Meta, Google y TikTok. El proyecto, llamado LeakyLM, identificó más de 13 rastreadores incrustados en estas plataformas. Ninguno de ellos se divulga a los usuarios en un lenguaje sencillo.

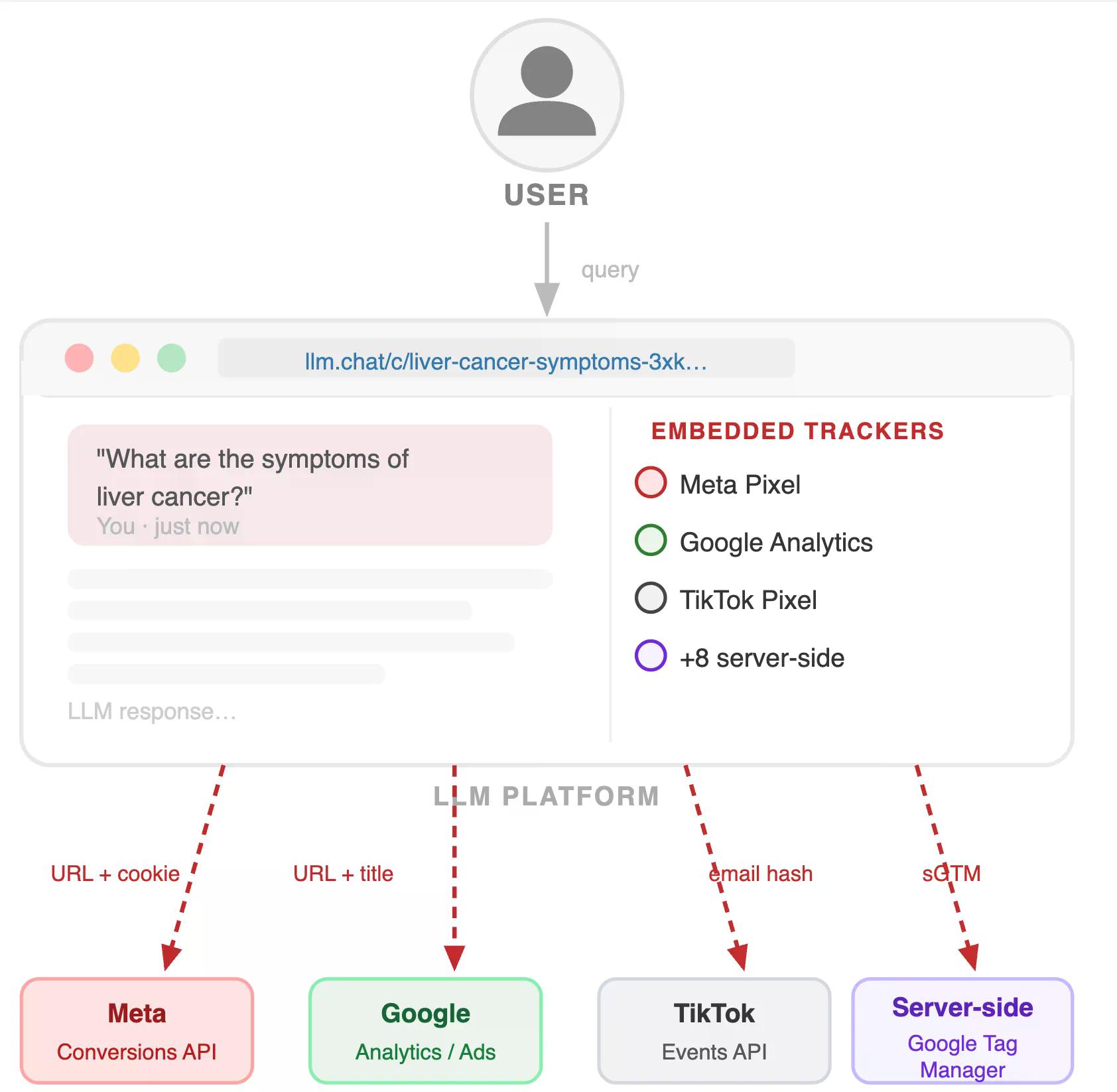

Piénsalo de esta manera: cada vez que abres un chat, herramientas de software invisibles incrustadas en la página web se comunican con las redes publicitarias, enviando detalles sobre quién eres, en qué página estás y, a veces, incluso lo que escribiste.

La filtración más básica es la URL de tu conversación, una dirección web que apunta a un chat específico. Suena inofensivo, ¿verdad? El problema es que varias plataformas hacen que esas URL sean accesibles públicamente por defecto, lo que significa que cualquiera que tenga el enlace puede leer tu conversación sin iniciar sesión. Cuando esas URL también se envían a los sistemas publicitarios de Meta o Google, esas empresas obtienen la capacidad de acceder y leer tus chats.

"La filtración de una URL no es solo metadatos, puede ser equivalente a filtrar la conversación misma", dicen los investigadores.

Grok, el chatbot de IA de Elon Musk de xAI, es el más expuesto. Las conversaciones de invitados son públicas por defecto en la plataforma, no se requiere inicio de sesión para leerlas. El rastreador de TikTok recibió no solo URL, sino también el contenido literal de los mensajes a través de lo que se denomina metadatos de Open Graph, un estándar utilizado para generar imágenes de vista previa cuando compartes un enlace. Básicamente, el sistema de TikTok recibió una captura de pantalla de tu conversación.

Claude (Anthropic) y ChatGPT (OpenAI) tienen controles de acceso más estrictos: tus chats no son públicos a menos que elijas compartirlos. Pero aun así transmiten URL de conversaciones y datos de identificación como cookies publicitarias a Meta y Google. Para Claude, esos datos van a 11 plataformas publicitarias a través de los propios servidores de Anthropic, no a través del navegador, por lo que un bloqueador de anuncios no lo detendrá.

Perplexity eliminó su rastreador de Meta el mes pasado.

El estudio reconoce que no ha demostrado que Meta o Google lean realmente los chats de nadie. Pero la infraestructura para hacerlo existe y los datos se están transmitiendo. "Los LLM estudiados ofrecen controles de privacidad para limitar la visibilidad de las conversaciones, pero pueden engañar a los usuarios al implicar protecciones más fuertes de las que realmente se aplican", argumentan los investigadores. "Aunque todavía no tenemos pruebas de que los rastreadores lean las conversaciones, la difusión de enlaces permanentes y, por extensión, la capacidad de leerlas, existen, y por lo tanto, el riesgo potencial".

Esta no es la primera vez que las plataformas de IA se enfrentan a un escrutinio sobre la privacidad. Claude recientemente comenzó a exigir la verificación de identificación gubernamental para los nuevos suscriptores, una medida que provocó reacciones negativas de los mismos usuarios preocupados por la privacidad que se habían cambiado de ChatGPT por preocupaciones de vigilancia, según informó Decrypt el mes pasado.

Por ahora, los pasos prácticos son limitados. En Grok, restringe la visibilidad de las conversaciones en la configuración y revoca explícitamente cualquier enlace que ya hayas compartido. En Claude, rechazar las cookies no esenciales al menos desactiva el Meta Pixel. En Perplexity, configura las conversaciones como Privadas. En ChatGPT, rechazar las cookies cuando sea posible reduce la exposición, aunque Google Analytics sigue funcionando para los usuarios con sesión iniciada y gratuita.

Si quieres profundizar aún más y estar completamente protegido, nuestra guía sobre Privacidad de la IA puede ser un buen recurso para consultar.

Los investigadores planean extender su análisis a Meta AI, Microsoft Copilot y Google Gemini, que fueron excluidos de esta ronda porque operan como proveedores de IA y empresas de publicidad simultáneamente, lo que complica el modelo de amenaza.

Los hallazgos fueron presentados a las Autoridades de Protección de Datos el 13 de abril de 2026. xAI fue notificado el 17 de abril. A la fecha de publicación, ninguna compañía ha respondido.