Una jueza federal de EE. UU. en San Francisco ha concedido la solicitud de Anthropic de un aplazamiento temporal después de la designación de la compañía por parte del Pentágono como un riesgo para la cadena de suministro.

En una orden del jueves, la jueza Rita Lin del Tribunal de Distrito para el Distrito Norte de California ordenó una medida cautelar preliminar contra el Pentágono por dicha etiqueta. También detiene temporalmente una directiva del presidente de EE. UU., Donald Trump, que ordenaba a las agencias federales dejar de usar el chatbot de Anthropic, Claude.

"Nada en el estatuto rector apoya la noción orwelliana de que una empresa estadounidense pueda ser tildada de adversario potencial y saboteador de EE. UU. por expresar su desacuerdo con el gobierno", dijo la jueza Lin.

Anthropic era el actor principal en los mercados de IA empresarial con un 32%, por delante de OpenAI con un 25%, a partir de 2025, según Menlo Ventures. Una prohibición gubernamental general sobre Anthropic haría caer en picada esta posición.

La jueza dijo que estas "amplias medidas punitivas" tomadas contra Anthropic por la administración Trump y el Secretario de Defensa Pete Hegseth parecían "arbitrarias, caprichosas [y] un abuso de discreción".

La orden se produjo después de que Anthropic presentara una demanda en un tribunal federal de Columbia el 9 de marzo, alegando que Hegseth se excedió en su autoridad cuando designó a la empresa como un riesgo para la cadena de suministro de seguridad nacional.

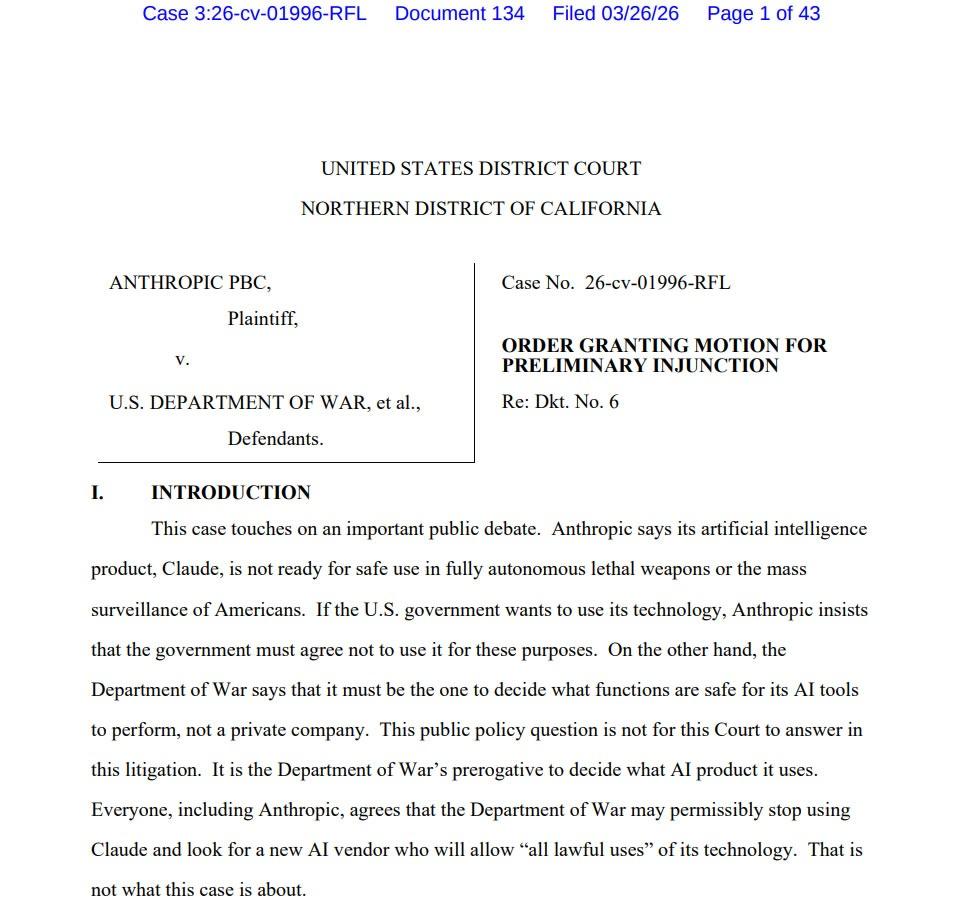

La disputa surge de un acuerdo en julio de 2025 entre la firma de IA y el Pentágono sobre un contrato para hacer de Claude el primer modelo de IA de vanguardia aprobado para su uso en redes clasificadas.

Las negociaciones se interrumpieron en febrero con el Pentágono buscando renegociar, insistiendo en que Anthropic permitiera el uso militar de Claude "para todos los fines legales" y sin restricciones.

Anthropic mantuvo que su tecnología no debería usarse para armas autónomas letales ni para la vigilancia masiva doméstica de los estadounidenses.

El 27 de febrero, Trump ordenó a todas las agencias federales que dejaran de usar los productos de Anthropic. "Los lunáticos de izquierda de Anthropic han cometido un ERROR DESASTROSO al intentar COACCIONAR al Departamento de Guerra", escribió en Truth Social.

Una audiencia judicial de 90 minutos tuvo lugar en San Francisco el 24 de marzo, durante la cual la jueza Lin presionó a los abogados del gobierno sobre si Anthropic estaba siendo castigada por criticar públicamente al Pentágono.

"Castigar a Anthropic por someter a escrutinio público la postura de contratación del gobierno es una clásica represalia ilegal de la Primera Enmienda", afirmó el fallo del 26 de marzo.

Anthropic dijo en un comunicado que estaba "agradecida a la corte por actuar con rapidez y complacida de que estén de acuerdo en que Anthropic probablemente tendrá éxito en los méritos".

Revista: Nadie sabe si la criptografía cuántica segura funcionará