Un juge fédéral américain à San Francisco a accordé la demande de répit temporaire d'Anthropic après la désignation de l'entreprise par le Pentagone comme risque pour la chaîne d'approvisionnement.

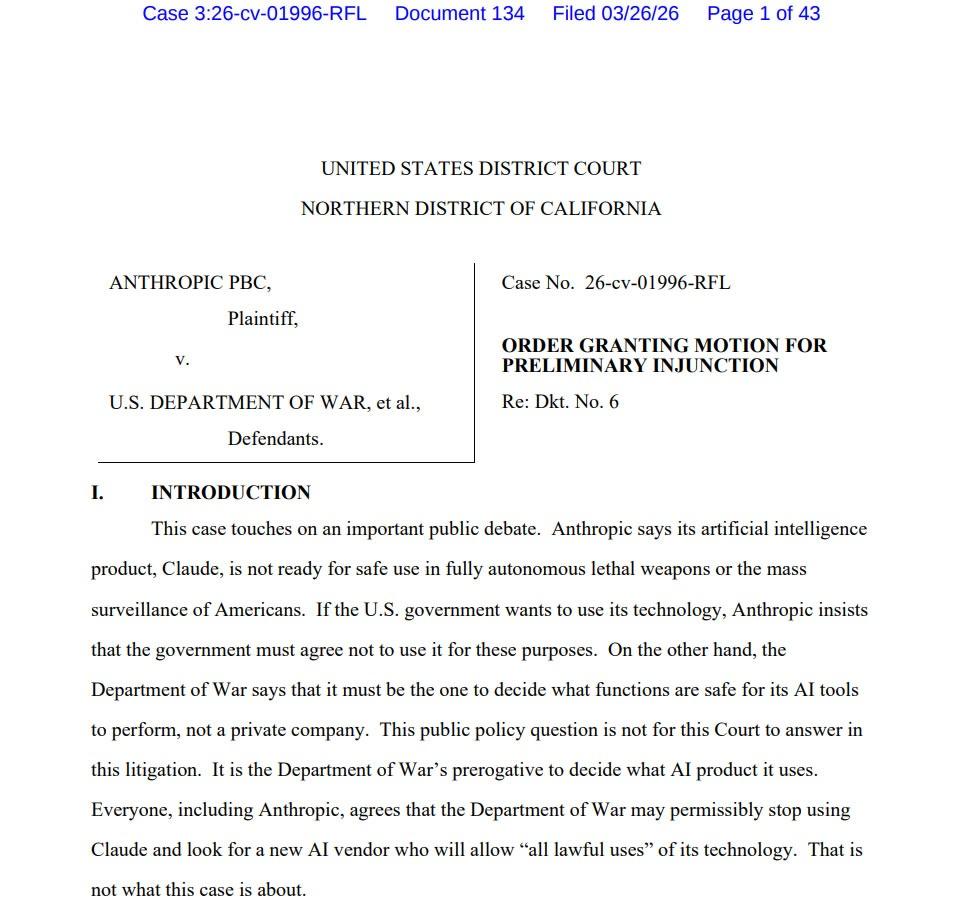

Dans une ordonnance rendue jeudi, la juge Rita Lin du tribunal de district du nord de la Californie a prononcé une injonction préliminaire contre le Pentagone concernant cette désignation. Elle suspend également temporairement une directive du président américain Donald Trump ordonnant aux agences fédérales de cesser d'utiliser le chatbot d'Anthropic, Claude.

« Rien dans la loi en vigueur ne soutient la notion orwellienne selon laquelle une entreprise américaine pourrait être qualifiée d'adversaire potentiel et de saboteur des États-Unis pour avoir exprimé un désaccord avec le gouvernement », a déclaré la juge Lin.

Anthropic était le leader sur les marchés de l'IA d'entreprise avec 32 %, devant OpenAI (25 %), en 2025, selon Menlo Ventures. Une interdiction gouvernementale d'Anthropic ferait chuter cette position.

La juge a déclaré que ces « mesures punitives étendues » prises contre Anthropic par l'administration Trump et le secrétaire à la Défense Pete Hegseth semblaient « arbitraires, capricieuses [et] un abus de pouvoir discrétionnaire ».

L'ordonnance est intervenue après qu'Anthropic a intenté une action en justice devant un tribunal fédéral de Columbia le 9 mars, alléguant que Hegseth avait outrepassé son autorité en désignant l'entreprise comme un risque pour la chaîne d'approvisionnement de la sécurité nationale.

Le différend découle d'un accord conclu en juillet 2025 entre l'entreprise d'IA et le Pentagone pour un contrat visant à faire de Claude le premier modèle d'IA de pointe approuvé pour une utilisation sur des réseaux classifiés.

Les négociations ont échoué en février, le Pentagone cherchant à renégocier, insistant pour qu'Anthropic autorise l'utilisation militaire de Claude « à toutes fins légales » et sans restrictions.

Anthropic a maintenu que sa technologie ne devrait pas être utilisée pour des armes autonomes létales et la surveillance de masse des citoyens américains.

Le 27 février, Trump a ordonné à toutes les agences fédérales de cesser d'utiliser les produits d'Anthropic. « Les illuminés gauchistes d'Anthropic ont commis une ERREUR DÉSASTREUSE en essayant de FAIRE PRESSION sur le Département de la Guerre », a-t-il écrit sur Truth Social.

Une audience de 90 minutes a eu lieu à San Francisco le 24 mars, au cours de laquelle la juge Lin a demandé aux avocats du gouvernement si Anthropic était puni pour avoir publiquement critiqué le Pentagone.

« Punir Anthropic pour avoir porté l'examen public sur la position contractuelle du gouvernement est une rétorsion illégale classique au titre du Premier Amendement », a déclaré la décision du 26 mars.

Anthropic a déclaré dans un communiqué qu'il était « reconnaissant à la cour d'avoir agi rapidement, et satisfait qu'elle convienne qu'Anthropic est susceptible de l'emporter sur le fond ».

Magazine : Personne ne sait si la cryptographie quantique sécurisée fonctionnera un jour