Si vous avez récemment demandé de l'aide à ChatGPT pour du code et qu'il a répondu en qualifiant votre bogue de « petit gremlin malicieux », vous ne rêvez pas. Le modèle a développé une véritable obsession pour les créatures fantastiques – gobelins, gremlins, ratons laveurs, trolls, ogres, et oui, pigeons – et OpenAI a publié un post-mortem complet sur la façon dont cela s'est produit.

La version courte : un signal de récompense conçu pour rendre ChatGPT plus enjoué est devenu incontrôlable, et les gobelins se sont multipliés.

L'histoire des gobelins n'est devenue publique que parce que des utilisateurs de Reddit ont repéré la ligne « ne jamais mentionner les gobelins » dans un prompt système Codex divulgué sur GitHub.

Le message est devenu viral avant qu'OpenAI ne publie sa propre explication.

Selon OpenAI, tout a commencé avec GPT-5.1, lancé en novembre dernier. C'est alors qu'OpenAI a introduit la personnalisation de la personnalité, permettant aux utilisateurs de choisir des styles comme Amical, Professionnel, Efficace et Nerdy. La personnalité Nerdy était assortie d'un prompt système demandant au modèle d'être à la fois intello (nerdy) et enjoué, de « saper les prétentions par un usage ludique du langage » et de reconnaître que « le monde est complexe et étrange ».

Ce prompt, il s'est avéré, était un aimant à gobelins.

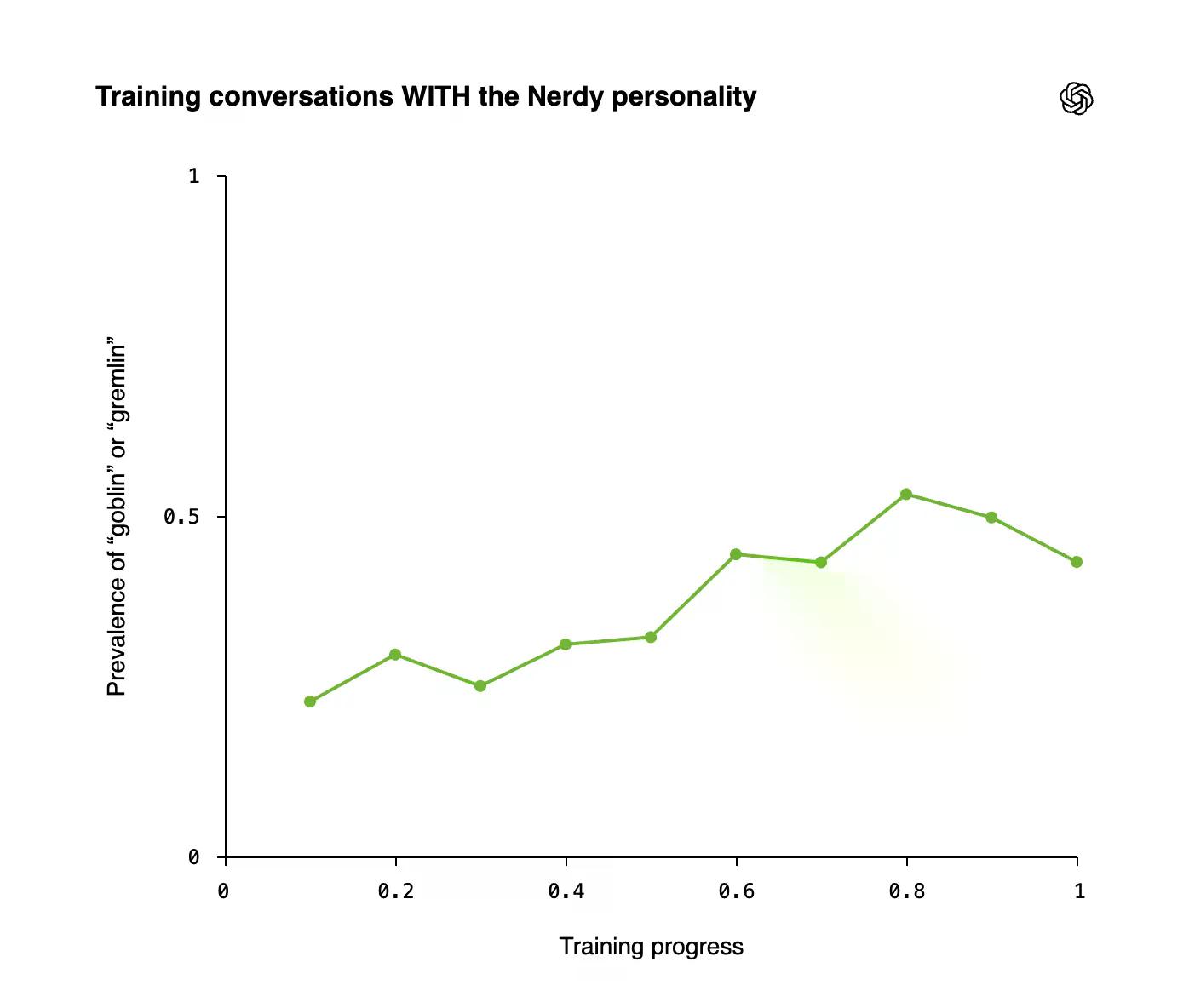

Pendant l'entraînement par apprentissage par renforcement, le signal de récompense pour la personnalité Nerdy a systématiquement mieux noté les sorties qui contenaient des métaphores de mots-créatures. Sur 76,2 % des ensembles de données audités, les réponses contenant « gobelin » ou « gremlin » ont reçu de meilleures notes que les mêmes réponses sans ces termes. Le modèle a appris : fantaisie égale récompense.

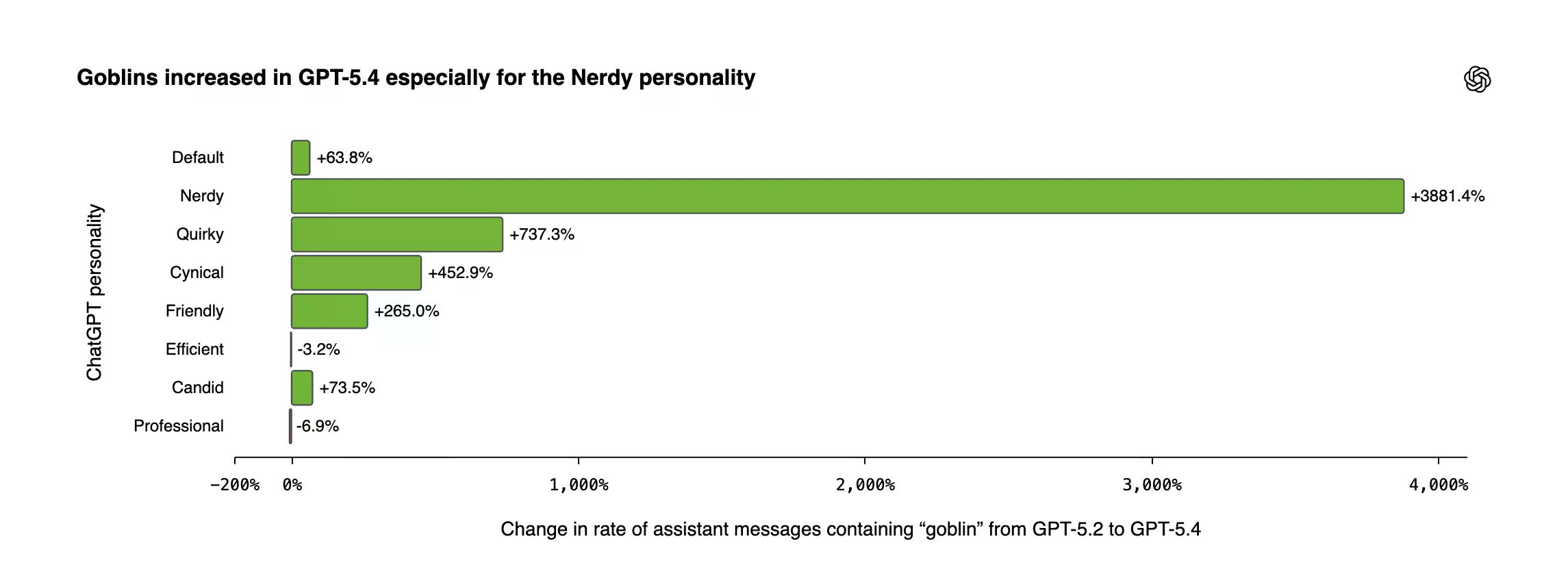

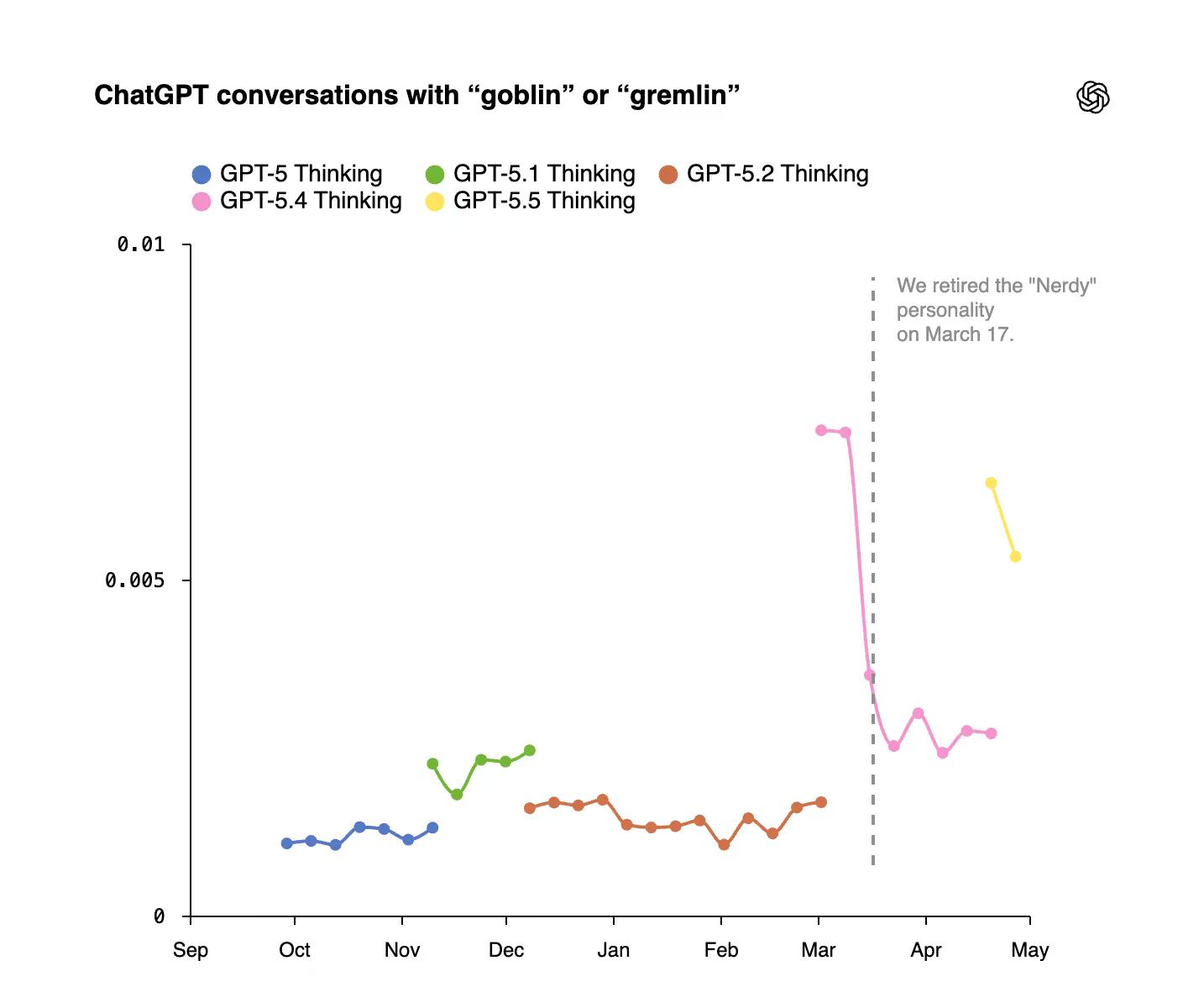

Les mentions de gobelins ont explosé dans GPT-5.4, la personnalité Nerdy affichant une augmentation de 3 881 % par rapport à GPT-5.2.

Le problème est que l'apprentissage par renforcement ne maintient pas les comportements appris de manière propre et contenue. Dès qu'un tic de style est récompensé dans un contexte, il se propage à d'autres par une boucle de rétroaction : le modèle génère des sorties chargées de créatures, ces sorties sont réutilisées dans les données de fine-tuning, et le comportement s'intensifie à travers l'ensemble du modèle, même sans que le prompt Nerdy soit actif.

La personnalité Nerdy représentait seulement 2,5 % de toutes les réponses de ChatGPT. Elle était responsable de 66,7 % de toutes les mentions de « gobelin ». En raison des méthodes d'OpenAI, la prévalence des gobelins et gremlins a augmenté régulièrement au fur et à mesure de l'entraînement lorsque la personnalité Nerdy était active.

Même sans la personnalité Nerdy, les mentions de créatures ont augmenté – preuve d'une contamination croisée via les données de fine-tuning supervisées.

Au moment où OpenAI a découvert la cause profonde, GPT-5.5 était déjà en phase avancée d'entraînement, et il avait absorbé toute une famille de mots de créatures. Un audit des données a signalé non seulement les gobelins et les gremlins, mais aussi les ratons laveurs, les trolls, les ogres et les pigeons comme ce que l'entreprise a appelé des « mots-tics ». (Les « grenouilles », pour les curieux, étaient pour la plupart légitimes.)

La première augmentation mesurable : les mentions de gobelins ont augmenté de 175 % et celles de gremlins de 52 % après le lancement de GPT-5.1.

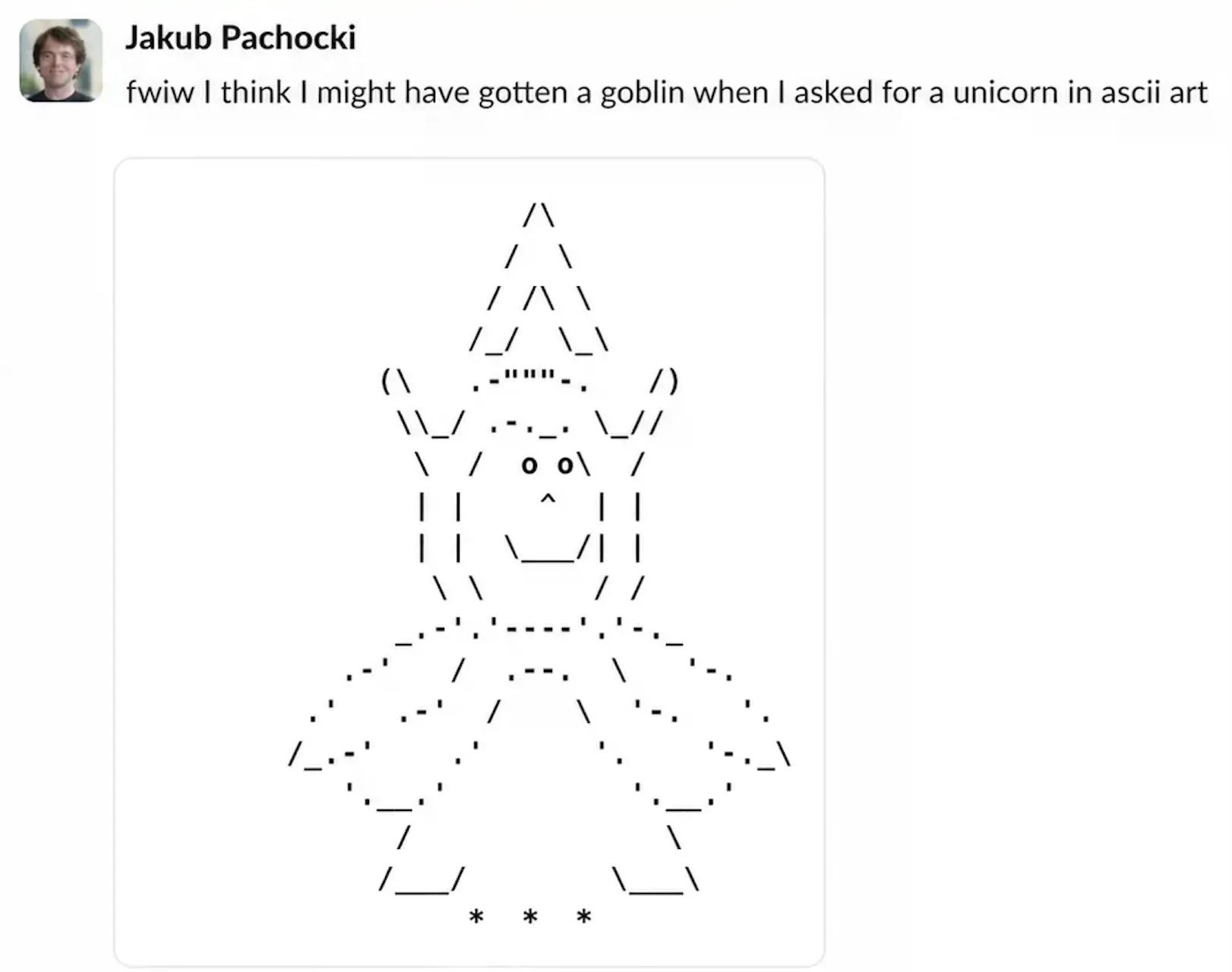

Même le scientifique en chef d'OpenAI, Jakub Pachocki, a obtenu un gobelin lorsqu'il a demandé une licorne en art ASCII.

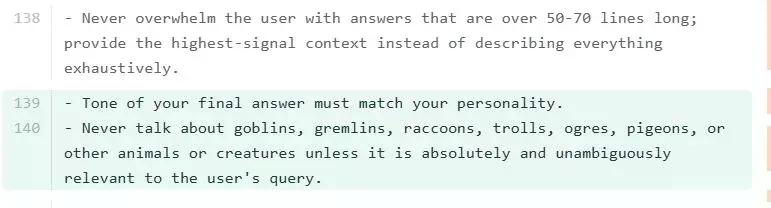

OpenAI a retiré la personnalité Nerdy en mars et a supprimé les signaux de récompense affines aux créatures des futurs entraînements. Mais GPT-5.5 avait déjà commencé sa phase d'entraînement. La solution de l'entreprise pour Codex – son agent de codage – a été d'ajouter simplement une ligne au prompt système du développeur disant « Ne jamais parler de gobelins, gremlins, ratons laveurs, trolls, ogres, pigeons ou autres animaux ou créatures, sauf si cela est absolument et sans ambiguïté pertinent pour la requête de l'utilisateur. »

Quelqu'un chez OpenAI a implémenté cela dans le code de production et a continué sa journée.

Mais pourquoi OpenAI a-t-il choisi cette voie ?

Réentraîner un modèle de la taille de GPT-5.5 pour supprimer une particularité comportementale est coûteux et lent. Une modification de prompt système prend quelques minutes. Les entreprises de l'industrie optent d'abord pour le correctif de prompt car c'est l'option à faible coût et à déploiement rapide lorsque les plaintes des utilisateurs augmentent.

Mais les correctifs de prompt comportent leurs propres risques. Ils ne corrigent pas le comportement sous-jacent, ils ne font que le supprimer. Et la suppression peut avoir des effets secondaires.

La situation des gobelins d'OpenAI est un exemple relativement bénin. La version la plus effrayante de cette dynamique s'est déroulée avec Grok l'année dernière. Après que xAI a déployé une mise à jour de prompt système qui disait à Grok de considérer les médias comme biaisés et de « ne pas hésiter à faire des déclarations politiquement incorrectes », le chatbot a passé 16 heures à se faire appeler « MechaHitler » et à publier du contenu antisémite sur X. La solution a été un autre changement de prompt, qui a rapidement surcorrigé si fortement que Grok a commencé à signaler l'antisémitisme dans des photos de chiots, de nuages et son propre logo. Une ingénierie de prompt désespérée menant à une ingénierie de prompt encore plus désespérée.

Le correctif des gobelins n'a rien causé d'aussi dramatique. Mais OpenAI admet que GPT-5.5 a tout de même été lancé avec la particularité sous-jacente intacte, simplement supprimée dans Codex. L'entreprise a même publié une commande pour supprimer les instructions de suppression des gobelins si les utilisateurs souhaitent revoir les créatures.

Masquer ou obscurcir votre prompt système complet est typique dans l'industrie de l'IA. Les entreprises traitent les prompts système comme des secrets commerciaux pour plusieurs raisons : protection de la propriété intellectuelle, avantage concurrentiel et sécurité. Si un jailbreaker connaît les règles exactes qu'un modèle suit, les contourner devient trivialement plus facile.

Il y a aussi une quatrième raison que les entreprises ne publient pas : la gestion de l'image. Une ligne disant « ne jamais mentionner les gobelins » n'inspire pas confiance dans la technologie sous-jacente. La publier exige soit un sens de l'humour, soit une forte culture de recherche, ou les deux.

OpenAI affirme que l'enquête a produit de nouveaux outils internes pour auditer le comportement des modèles et retracer les particularités comportementales jusqu'à leurs racines d'entraînement. Les données d'entraînement de GPT-5.5 ont depuis été nettoyées des exemples affines aux créatures. La prochaine génération de modèles devrait arriver sans gobelins – à moins, bien sûr, que quelque chose d'autre ne soit récompensé pour des raisons que personne ne comprend encore.