Mistral AI a lancé Mistral Medium 3.5 le 29 avril. Le laboratoire parisien a annoncé un modèle dense de 128 milliards de paramètres, un ensemble de fonctionnalités d'agentique – et a aussitôt rencontré un mur de réactions mitigées en ligne.

La sortie s'est déroulée en trois parties. Premièrement, le modèle lui-même. Deuxièmement, des agents de codage à distance via Mistral Vibe CLI – des sessions de codage basées sur le cloud qui peuvent envoyer des requêtes de tirage (pull requests) vers GitHub et s'exécuter en parallèle sans que vous ayez à rester devant un terminal. Troisièmement, le mode Travail dans Le Chat, l'interface utilisateur de Mistral de style ChatGPT, qui gère désormais des tâches autonomes en plusieurs étapes comme le tri des e-mails, la synthèse de recherche et les flux de travail inter-outils.

De grandes ambitions, mais une réalité de benchmark compliquée.

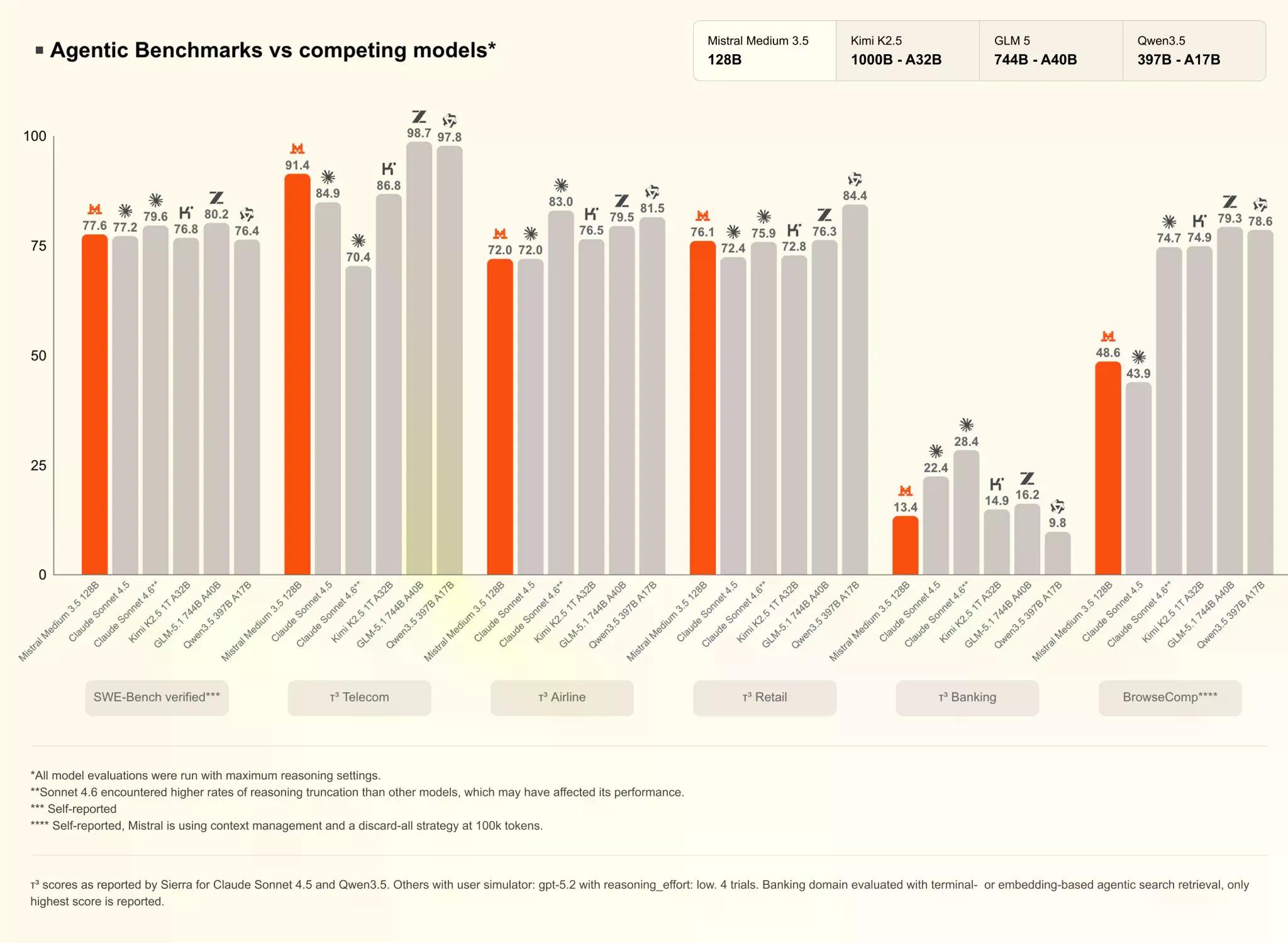

Medium 3.5 obtient un score de 77,6 % sur SWE-Bench Verified – un benchmark de codage qui teste la capacité d'un modèle à corriger de véritables problèmes GitHub en générant des correctifs fonctionnels. Il atteint également 91,4 % sur τ³-Telecom, qui mesure l'utilisation d'outils agentiques dans des environnements spécialisés. Mistral a également fusionné trois modèles précédemment distincts (Medium 3.1, Magistral et Devstral 2) en un seul ensemble de poids avec un effort de raisonnement configurable par requête.

Un modèle unifié remplaçant trois est une réelle victoire technique. Le problème réside dans son coût et sa concurrence.

Mistral facture 1,50 $ par million de tokens d'entrée et 7,50 $ par million de tokens de sortie. Le Qwen 3.6 d'Alibaba, avec ses 27 milliards de paramètres – moins d'un quart du nombre de paramètres de Medium 3.5 – obtient un score de 72,4 % sur le même benchmark SWE-Bench Verified et est distribué sous licence Apache 2.0, ce qui signifie que vous pouvez le télécharger et l'exécuter gratuitement.

Les paramètres sont ce qui détermine la capacité d'une IA à apprendre, raisonner et stocker des informations. Plus il y a de paramètres, plus l'étendue des connaissances du modèle est vaste.

Parcourez les classements open source et le tableau est frappant. Les premières places sont occupées par le Qwen d'Alibaba, le GLM de Zhipu AI (Chine) et le MiMo-V2 de Xiaomi, tous étant moins chers, plus puissants et plus compétitifs que la nouvelle version de Mistral. Medium 3.5 n'a même pas encore été classé sur les principaux classements indépendants – les évaluations de tiers sont toujours en attente.

Le seul point positif, cependant, comme certains l'affirment, est que Mistral est, à ce stade, le seul modèle non chinois à avoir une présence sérieuse dans la conversation open source.

Je pense que Mistral a la 10e plus haute valorisation de toute la scène de l'IA (quelque chose comme ça).

Tout cela alors qu'ils sortent constamment certains des pires modèles.

Ils ont survécu grâce à la bureaucratie, au lobbying et à la politique européenne.

Tout cela parce qu'ils ont convaincu des bureaucrates déments… https://t.co/kh7ASvdi7C

— Youssof Altoukhi (@Youssofal_) April 29, 2026

Pedro Domingos, professeur d'apprentissage automatique à l'Université de Washington, n'y est pas allé de main morte :

"Les entreprises d'IA ordinaires se vantent de la supériorité de leur modèle sur les benchmarks. Seul Mistral se vante de la médiocrité du sien."

Les entreprises d'IA ordinaires se vantent de la supériorité de leur modèle sur les benchmarks. Seul Mistral se vante de la médiocrité du sien. pic.twitter.com/WcAKskaVpL

— Pedro Domingos (@pmddomingos) April 30, 2026

Il a enchaîné avec une question plus incisive : "Je ne sais pas ce qui est pire, que l'Europe ne participe pas à la course à l'IA ou qu'elle soit représentée par un objet de risée comme Mistral."

Youssof Altoukhi, fondateur de Yoyo Studios, a fait le calcul : Qwen 3.6, avec 27 milliards de paramètres, est 4,7 fois plus petit que Medium 3.5 et obtient des scores comparables en codage. Le prix de sortie de Medium 3.5 le place aux côtés de modèles propriétaires qui obtiennent des scores significativement plus élevés sur tous les benchmarks majeurs.

« Sans leur habileté politique, ils auraient fait faillite à l'heure qu'il est », a-t-il déclaré.

Tout le monde n'a pas été purement dédaigneux. Le développeur d'IA Michal Langmajer a capturé l'ambivalence :

"Je suis sincèrement heureux qu'il y ait encore un laboratoire non américain, non chinois qui essaie de construire des LLM de pointe, mais bon sang, nous devons élever notre niveau de jeu en Europe. Leur nouveau modèle phare n'est fondamentalement 'pas le meilleur' sur aucun benchmark, et pourtant il coûte plusieurs fois plus cher que la plupart des concurrents."

Je suis sincèrement heureux qu'il y ait encore un laboratoire non américain, non chinois qui essaie de construire des LLM de pointe (@MistralAI) mais bon sang, nous devons élever notre niveau de jeu en Europe.

Leur nouveau modèle phare n'est fondamentalement « pas le meilleur » sur aucun benchmark, et pourtant il coûte plusieurs fois plus cher que la plupart des concurrents... pic.twitter.com/JwvR5eKWmT

— Michal Langmajer (@MichalLangmajer) April 30, 2026

Certains développeurs ont fait valoir que les poids ouverts sont un atout de durabilité, pas un objectif de classement. Un modèle que n'importe qui peut télécharger, affiner et auto-héberger n'a pas besoin de gagner les classements aujourd'hui pour rester pertinent. D'autres ont souligné les déploiements réels de Mistral en entreprise à travers l'Europe comme preuve que l'avantage n'est pas purement technique.

C'est là que réside la véritable proposition de Mistral.

Les entreprises européennes soumises au RGPD, les banques traitant des données clients sensibles et les gouvernements qui ne veulent pas acheminer leurs charges de travail d'IA via des infrastructures chinoises ont des options limitées. Comme Decrypt l'a rapporté en décembre dernier, HSBC a signé un accord pluriannuel avec Mistral spécifiquement pour auto-héberger des modèles sur sa propre infrastructure. L'attrait d'un laboratoire européen à poids ouverts, valorisé à 14 milliards de dollars, n'apparaît pas dans les tableaux de benchmarks, mais il se manifeste dans les décisions d'approvisionnement.

Pas le meilleur en codage, et pas le moins cher. Mais il est : non américain, non chinois, auditable, auto-hébergeable et légalement sûr pour les entreprises européennes.