Chạy một mô hình AI trên máy tính của riêng bạn thật tuyệt vời—cho đến khi nó không còn tuyệt vời nữa.

Lời hứa hẹn là sự riêng tư, không phí đăng ký và không dữ liệu nào rời khỏi máy của bạn. Thực tế, đối với hầu hết mọi người, là phải nhìn con trỏ nhấp nháy trong năm giây giữa các câu.

Nút thắt cổ chai đó có tên: tốc độ suy luận. Và nó không liên quan gì đến việc mô hình thông minh đến đâu. Đó là một vấn đề phần cứng. Các mô hình AI tiêu chuẩn tạo văn bản từng mảnh từ—gọi là token—một lần. Phần cứng phải di chuyển hàng tỷ tham số từ bộ nhớ đến các đơn vị tính toán chỉ để tạo ra mỗi token. Nó chậm theo thiết kế. Trên phần cứng tiêu dùng, điều đó thật đau khổ.

Giải pháp thay thế mà hầu hết mọi người tìm đến là chạy các mô hình nhỏ hơn, yếu hơn—hoặc các phiên bản nén nặng, gọi là mô hình lượng tử hóa (quantized models), hy sinh một phần chất lượng để đổi lấy tốc độ. Cả hai giải pháp đều không tối ưu. Bạn có được thứ gì đó hoạt động, nhưng đó không phải là mô hình bạn thực sự muốn.

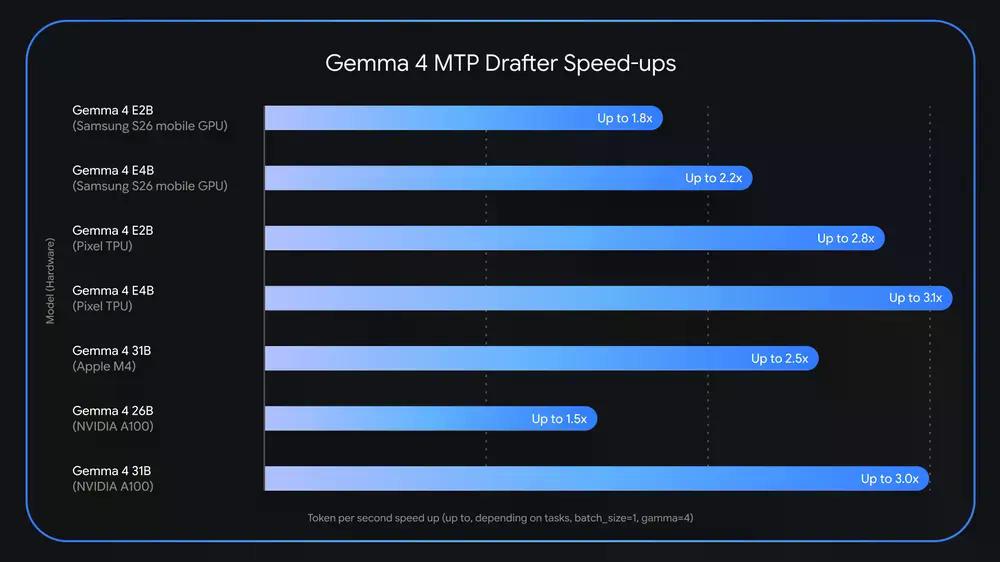

Giờ đây, Google có một ý tưởng khác. Công ty vừa phát hành các công cụ dự thảo Multi-Token Prediction (MTP) cho dòng mô hình mã nguồn mở Gemma 4 của mình—một kỹ thuật có thể tăng tốc độ lên tới 3 lần mà không ảnh hưởng đến chất lượng hay khả năng suy luận của mô hình.

Phương pháp này được gọi là giải mã suy đoán (speculative decoding), và nó đã tồn tại dưới dạng một khái niệm trong nhiều năm. Các nhà nghiên cứu của Google đã công bố bài báo nền tảng vào năm 2022. Ý tưởng này chưa trở nên phổ biến cho đến bây giờ vì nó đòi hỏi kiến trúc phù hợp để hoạt động ở quy mô lớn.

Đây là phiên bản ngắn gọn về cách nó hoạt động. Thay vì để mô hình lớn, mạnh mẽ tự mình làm tất cả công việc, bạn ghép nối nó với một mô hình "drafter" (dự thảo) nhỏ. Mô hình dự thảo này nhanh và rẻ—nó dự đoán nhiều token cùng lúc trong thời gian ngắn hơn so với việc mô hình chính tạo ra chỉ một token. Sau đó, mô hình lớn kiểm tra tất cả các dự đoán đó trong một lần duy nhất. Nếu các dự đoán đúng, bạn sẽ có toàn bộ chuỗi với chi phí của một lượt truyền tới (forward pass) duy nhất.

Theo Google, "nếu mô hình mục tiêu đồng ý với bản dự thảo, nó sẽ chấp nhận toàn bộ chuỗi trong một lần truyền tới duy nhất—và thậm chí còn tạo ra một token bổ sung của riêng nó trong quá trình."

Không có gì bị hy sinh: Mô hình lớn—ví dụ, phiên bản 31B dense của Gemma 4—vẫn xác minh từng token, và chất lượng đầu ra là hoàn toàn giống nhau. Bạn chỉ đang khai thác sức mạnh tính toán nhàn rỗi vốn không được sử dụng trong các phần chậm.

Google cho biết các mô hình dự thảo chia sẻ KV cache của mô hình mục tiêu—một cấu trúc bộ nhớ lưu trữ ngữ cảnh đã được xử lý—để chúng không lãng phí thời gian tính toán lại những thứ mà mô hình lớn hơn đã biết. Đối với các mô hình biên nhỏ hơn được thiết kế cho điện thoại và thiết bị Raspberry Pi, nhóm thậm chí đã xây dựng một kỹ thuật gom nhóm hiệu quả để cắt giảm thêm thời gian tạo.

Đây không phải là nỗ lực duy nhất mà thế giới AI đã thực hiện để song song hóa việc tạo văn bản. Các mô hình ngôn ngữ dựa trên khuếch tán—như Mercury từ Inception Labs—đã thử một cách tiếp cận hoàn toàn khác: Thay vì dự đoán từng token một, chúng bắt đầu bằng nhiễu và tinh chỉnh dần dần toàn bộ đầu ra. Điều đó nghe có vẻ nhanh trên lý thuyết, nhưng các LLM dựa trên khuếch tán đã gặp khó khăn trong việc sánh kịp chất lượng của các mô hình transformer truyền thống, khiến chúng thiên về một sự tò mò nghiên cứu hơn là một công cụ thực tế.

Giải mã suy đoán khác biệt vì nó không thay đổi mô hình cơ bản chút nào. Đó là một tối ưu hóa phục vụ, không phải là một sự thay thế kiến trúc. Cùng một Gemma 4 mà bạn đã chạy giờ đây trở nên nhanh hơn.

Lợi ích thực tế là có thật. Một mô hình Gemma 4 26B chạy trên GPU Nvidia RTX Pro 6000 desktop đạt được số token mỗi giây gần gấp đôi khi bật công cụ dự thảo MTP, theo các điểm chuẩn của Google. Trên Apple Silicon, kích thước lô từ 4 đến 8 yêu cầu mở khóa tốc độ tăng khoảng 2,2 lần. Không hoàn toàn đạt mức trần 3 lần trong mọi trường hợp, nhưng vẫn là một sự khác biệt đáng kể giữa "gần như không thể sử dụng được" và "thực sự đủ nhanh để làm việc".

Ngữ cảnh ở đây rất quan trọng. Khi mô hình DeepSeek của Trung Quốc gây sốc thị trường vào tháng 1 năm 2025—xóa sổ 600 tỷ USD khỏi vốn hóa thị trường của Nvidia chỉ trong một ngày—bài học cốt lõi là việc tăng cường hiệu quả có thể tác động mạnh hơn là sức mạnh tính toán thô. Chạy thông minh hơn sẽ tốt hơn việc chỉ đơn thuần bổ sung thêm phần cứng để giải quyết vấn đề. Công cụ dự thảo MTP của Google là một bước đi khác theo hướng đó, nhưng nhắm thẳng vào phân khúc người tiêu dùng.

Toàn bộ ngành công nghiệp AI hiện là một tam giác bao gồm suy luận, đào tạo và bộ nhớ. Mỗi bước đột phá trong bất kỳ lĩnh vực nào cũng có xu hướng thúc đẩy hoặc gây sốc cho toàn bộ hệ sinh thái. Phương pháp đào tạo của DeepSeek (đạt được các mô hình mạnh mẽ với phần cứng cấp thấp hơn) là một ví dụ, trong khi bài báo TurboQuant của Google (thu nhỏ bộ nhớ AI mà không làm giảm chất lượng) là một ví dụ khác. Cả hai đều đã gây chấn động thị trường khi các công ty cố gắng tìm ra hướng đi.

Google cho biết công cụ dự thảo giúp "cải thiện khả năng phản hồi: giảm đáng kể độ trễ cho trò chuyện gần thời gian thực, ứng dụng giọng nói nhập vai và quy trình làm việc tự động"—những loại tác vụ đòi hỏi độ trễ thấp để cảm thấy hữu ích.

Các trường hợp sử dụng nhanh chóng được làm rõ: Một trợ lý mã hóa cục bộ không bị lag; một giao diện giọng nói phản hồi trước khi bạn quên những gì mình đã hỏi; một quy trình làm việc tự động không bắt bạn phải đợi ba giây giữa các bước. Tất cả những điều này, trên phần cứng bạn đã sở hữu.

Các công cụ dự thảo MTP hiện có sẵn trên Hugging Face, Kaggle và Ollama, theo giấy phép Apache 2.0. Chúng hoạt động với vLLM, MLX, SGLang và Hugging Face Transformers ngay lập tức.