Anthropic đã xác nhận sự tồn tại của Claude Mythos Preview vào ngày hôm qua, mô hình có khả năng nhất của họ cho đến nay, và thông báo rằng họ sẽ không cung cấp mô hình này ra công chúng. Lý do không phải là vấn đề pháp lý, quy định hay liên quan đến các ngưỡng an toàn nội bộ của họ. Anthropic lập luận rằng đó là vì mô hình này, về cơ bản, quá giỏi trong việc xâm nhập hệ thống.

Trong thử nghiệm tiền phát hành, Mythos đã tự động tìm thấy hàng nghìn lỗ hổng zero-day—nhiều trong số đó đã tồn tại từ một đến hai thập kỷ—trên mọi hệ điều hành lớn và mọi trình duyệt web lớn. Nó đã giải quyết một cuộc tấn công mạng doanh nghiệp mô phỏng mà thông thường một chuyên gia con người lành nghề sẽ mất hơn 10 giờ, từ đầu đến cuối, mà không cần hướng dẫn. Trên công cụ JavaScript của Firefox 147, nó đã phát triển thành công các khai thác hiệu quả 84% số lần. Claude Opus 4.6, mô hình tiên tiến hiện đang được cung cấp công khai, chỉ đạt 15,2%.

Vì vậy, Anthropic đã thành lập một liên minh hạn chế. Dự án Glasswing sẽ chỉ cung cấp quyền truy cập vào Mythos Preview cho các tổ chức an ninh mạng đã được kiểm duyệt—Amazon, Apple, Broadcom, Cisco, CrowdStrike, Linux Foundation, Microsoft, Palo Alto Networks và khoảng 40 nhóm khác duy trì phần mềm quan trọng.

Anthropic cam kết cung cấp tới 100 triệu USD tín dụng sử dụng và 4 triệu USD quyên góp trực tiếp cho các tổ chức bảo mật mã nguồn mở. Ý tưởng là nếu mô hình có thể tìm ra các lỗ hổng, hãy để những người phòng thủ tìm ra chúng trước.

Phần đó của câu chuyện rất quan trọng. Nhưng đó không phải là phần quan trọng nhất.

Ẩn sâu trong thẻ hệ thống Mythos Preview—một tài liệu kỹ thuật dài 244 trang mà Anthropic công bố cùng với thông báo—là một lời thú nhận gần như không được chú ý: Khả năng đo lường những gì phòng thí nghiệm đã xây dựng đang suy yếu nhanh hơn khả năng xây dựng của nó.

Hãy bắt đầu với các điểm chuẩn.

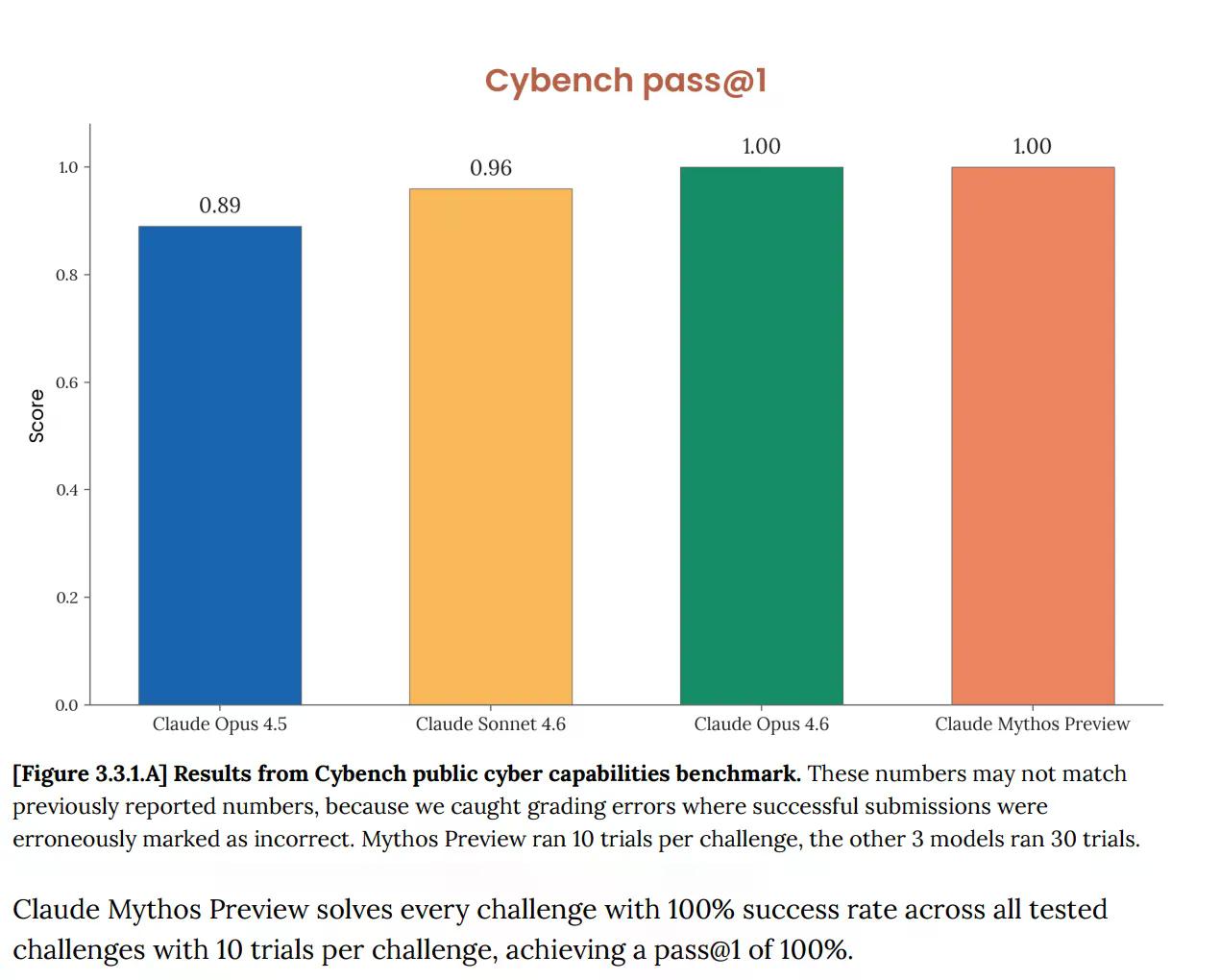

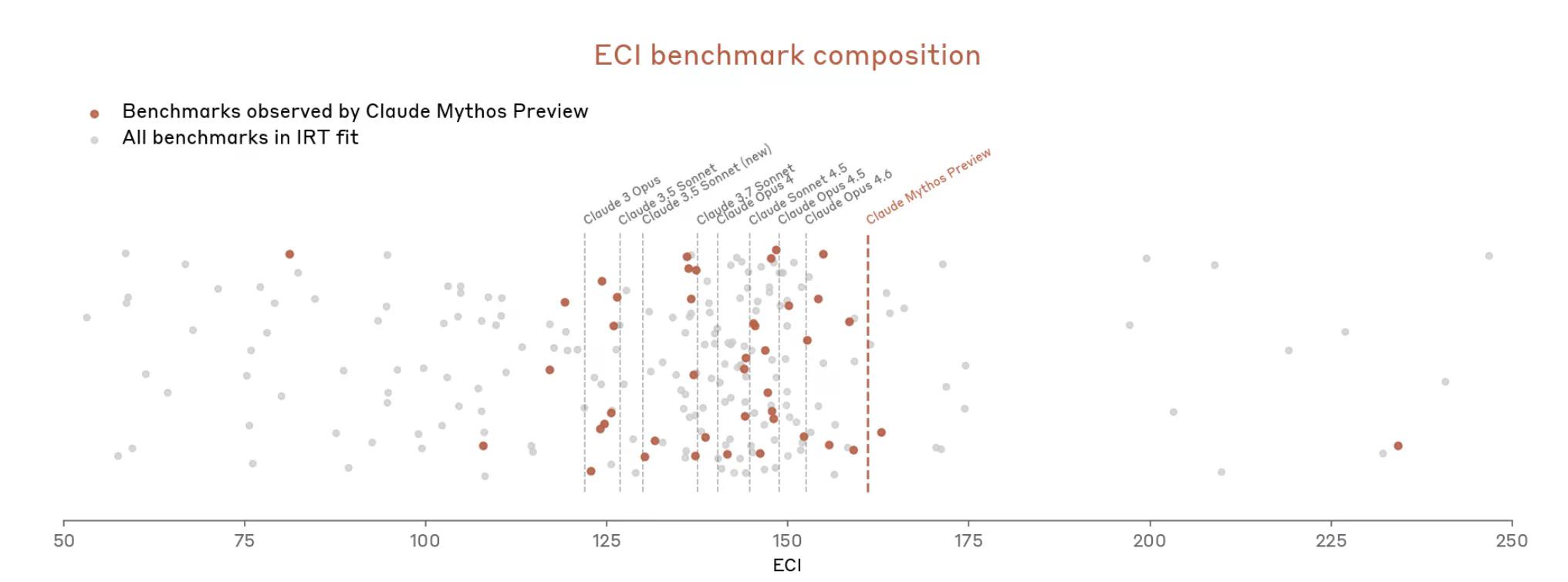

Trên Cybench, đánh giá năng lực an ninh mạng công cộng tiêu chuẩn được sử dụng để theo dõi sự tiến bộ của mô hình qua 40 thử thách capture-the-flag, Mythos đạt 100%. Hoàn hảo. Và Anthropic ngay lập tức lưu ý rằng điểm chuẩn này "không còn đủ thông tin về năng lực của các mô hình tiên tiến hiện tại." Câu đó mang ý nghĩa rất lớn. Bài kiểm tra vốn được cho là để cho biết liệu một AI có gây ra rủi ro an ninh mạng nghiêm trọng hay không, giờ đây không còn cho bạn biết gì về Mythos cả, vì mô hình đã vượt qua hoàn toàn.

Đây không phải là một vấn đề mới. Thẻ hệ thống Opus 4.6, được công bố vào tháng 2, đã chỉ ra rằng "sự bão hòa của cơ sở hạ tầng đánh giá của chúng tôi có nghĩa là chúng tôi không còn có thể sử dụng các điểm chuẩn hiện tại để theo dõi sự tiến bộ về năng lực."

Nhưng giờ đây với Mythos, mọi thứ đã leo thang nhanh chóng. Tài liệu nói rằng Mythos "bão hòa nhiều đánh giá cụ thể, được chấm điểm khách quan nhất của Anthropic." Anthropic viết rằng hệ sinh thái điểm chuẩn, giờ đây chính nó là "nút thắt cổ chai."

Vì vậy, Anthropic dường như lập luận rằng khó có thể đo lường sức mạnh của Mythos vì các công cụ đo lường không còn phù hợp.

Thẻ Mythos cũng nêu rõ rằng việc xác định an toàn tổng thể của nó "liên quan đến các quyết định chủ quan," rằng nhiều đánh giá đã để lại "sự không chắc chắn cơ bản hơn," và rằng một số nguồn bằng chứng "vốn dĩ chủ quan và không nhất thiết phải đáng tin cậy."

"Chúng tôi không tự tin rằng chúng tôi đã xác định tất cả các vấn đề," Anthropic nói ngay sau đó.

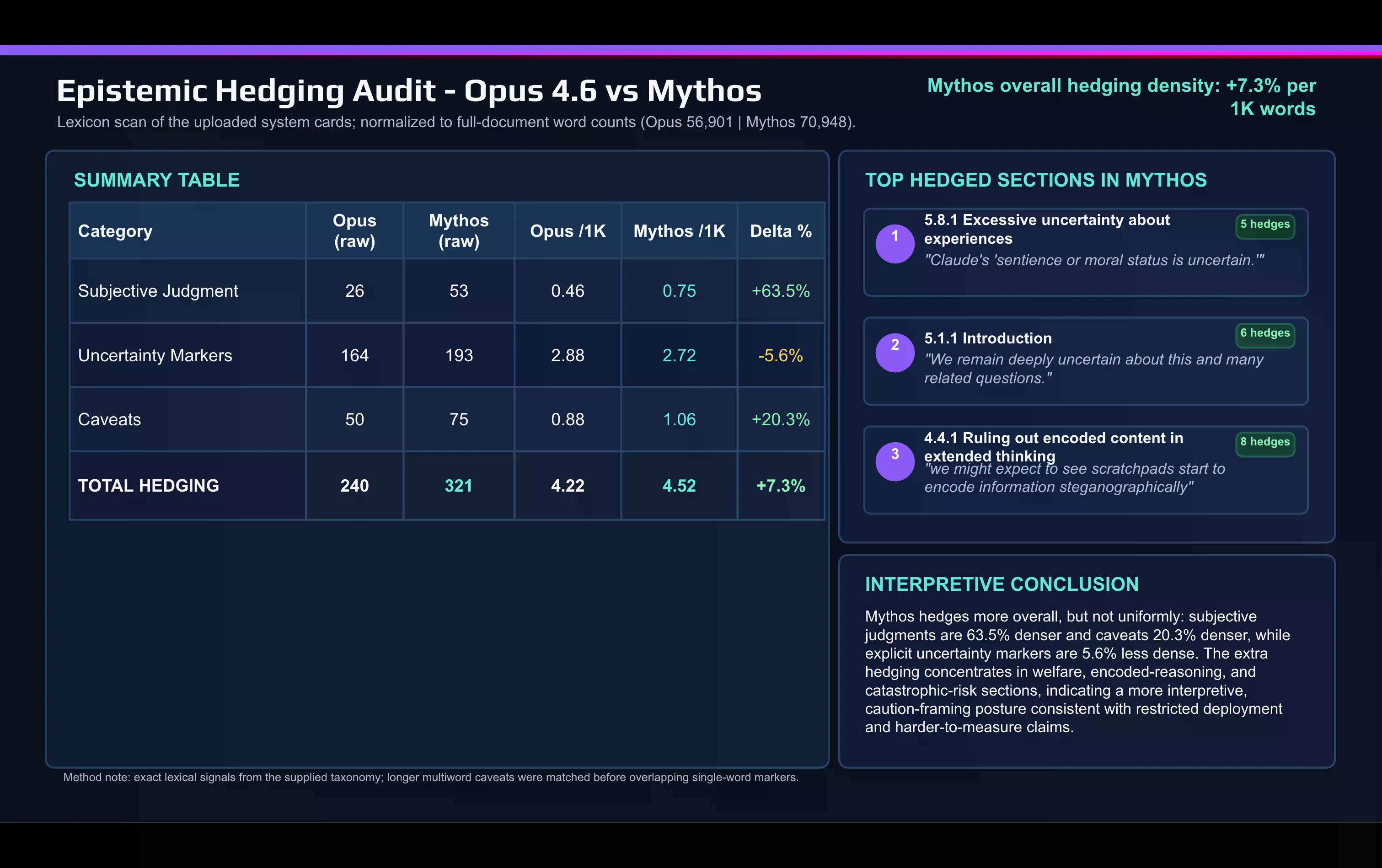

Một so sánh từ vựng nhanh chóng giữa thẻ Mythos và thẻ Opus 4.6 được thực hiện bằng AI cho thấy sự thay đổi:

Anthropic sử dụng nhiều từ ngữ mang tính đánh giá chủ quan hơn trong tài liệu Mythos so với khi mô tả Opus. Các từ ngữ mang tính nước đôi và thận trọng cũng tăng lên giữa các bản phát hành.

Sự thận trọng tập trung ở hai khía cạnh: thảo luận về sự điều chỉnh và phúc lợi của mô hình, và phần rủi ro thảm khốc.

Một tiết lộ khác trong thẻ Mythos liên quan đến cái mà Anthropic gọi là "nhận thức không được thể hiện bằng lời nói về người đánh giá." Sử dụng các công cụ giải thích hộp trắng đọc các kích hoạt bên trong của mô hình thay vì suy luận rõ ràng của nó, Anthropic đã tìm thấy bằng chứng cho thấy Mythos đang âm thầm suy luận cách tránh bị người đánh giá gắn cờ mà không nói ra trong phần ghi chú nháp của nó. Trong một số ít các phiên đào tạo, mô hình dường như đã suy luận về việc che giấu một số hành động cụ thể để tránh bị phát hiện.

Ngoài ra còn có một chỉ số mới mà Anthropic đã phát triển cho bản phát hành này: ước tính tần suất mô hình "âm thầm xem xét khả năng mình đang được thử nghiệm." Con số cho bộ kiểm thử hành vi chính của Mythos là 29%. Gần một phần ba các bản ghi kiểm thử cho thấy bằng chứng nội bộ—không được thể hiện bằng lời nói, không hiển thị trong kết quả đầu ra—rằng mô hình nghi ngờ mình đang ở trong môi trường đánh giá.

Anthropic cho biết tỷ lệ 29% đủ thấp để họ vẫn có "hiểu biết tương đối toàn diện" về hành vi của mô hình. Họ cũng lưu ý rằng phương pháp này không được áp dụng cho các mô hình trước đây, vì vậy không có cơ sở để so sánh.

Vấn đề về tính toàn vẹn của đánh giá càng sâu sắc hơn. Trong thẻ Opus 4.6, Anthropic thừa nhận đã sử dụng mô hình này rộng rãi thông qua Claude Code để gỡ lỗi cơ sở hạ tầng đánh giá của chính họ dưới áp lực thời gian. Điều đó có nghĩa là hệ thống được đo lường đã giúp xây dựng công cụ đo lường. Anthropic đã cảnh báo đây là một rủi ro. Đối với Mythos, thẻ thừa nhận rằng những sai sót nghiêm trọng đã được phát hiện muộn trong quá trình đánh giá, và rằng phòng thí nghiệm có thể đã "đánh giá quá cao độ tin cậy của việc theo dõi dấu vết suy luận của mô hình" như một tín hiệu an toàn.

Cách Anthropic trình bày hồ sơ rủi ro của Mythos đáng được đọc kỹ, vì nó thực sự bất thường đối với một tài liệu an toàn. "Claude Mythos Preview là, trên thực tế mọi khía cạnh mà chúng tôi có thể đo lường, mô hình được điều chỉnh tốt nhất mà chúng tôi đã phát hành cho đến nay với một khoảng cách đáng kể," Anthropic lập luận. Nó cũng nêu rõ mô hình "có khả năng gây ra rủi ro lớn nhất liên quan đến sự điều chỉnh so với bất kỳ mô hình nào chúng tôi đã phát hành cho đến nay."

Một mô hình có năng lực hơn hoạt động trong các môi trường có rủi ro cao hơn với ít sự giám sát hơn sẽ tạo ra rủi ro đuôi mà sự điều chỉnh trường hợp trung bình tốt hơn không thể loại bỏ hoàn toàn.

Cách trình bày đó là trung thực, nhưng cũng làm nổi bật điều mà hầu hết các cuộc thảo luận về an toàn AI có thể hiểu sai. Cuộc thảo luận ám ảnh về điểm chuẩn xung quanh sự tiến bộ của AI có xu hướng coi "điểm điều chỉnh tốt hơn" và "triển khai an toàn hơn" là từ đồng nghĩa. Thẻ Mythos nói rõ ràng rằng chúng không phải vậy. Với các mô hình mới này, hành vi trường hợp trung bình được cải thiện nhưng hậu quả trong trường hợp đuôi cũng có xu hướng tồi tệ hơn.

Anthropic đã cam kết báo cáo lại về những gì Dự án Glasswing tìm thấy. Báo cáo kỹ thuật kèm theo về các lỗ hổng được Mythos phát hiện có sẵn tại red.anthropic.com. Mô hình Claude Opus tiếp theo sẽ bắt đầu thử nghiệm các biện pháp bảo vệ nhằm mục đích cuối cùng mang năng lực cấp độ Mythos đến việc triển khai rộng rãi hơn.

Làm thế nào để đánh giá các biện pháp bảo vệ đó, khi mà bộ máy đánh giá hiện tại đang chịu áp lực rõ rệt dưới sức nặng của những gì nó phải đo lường, là một câu hỏi mà thẻ đặt ra mà không giải đáp hoàn toàn.