CEO-ul Nvidia, Jensen Huang, a participat la podcastul lui Lex Fridman săptămâna trecută și a declarat, fără ocolișuri: „Cred că am atins AGI”. Două zile mai târziu, cel mai riguros test din cercetarea AI a lansat cel mai nou benchmark de inteligență generală artificială – și fiecare model de frontieră a obținut un scor sub 1%.

Fundația ARC Prize a lansat ARC-AGI-3 săptămâna aceasta, iar rezultatele sunt brutale. Gemini 3.1 Pro de la Google a condus cu 0,37%. GPT-5.4 de la OpenAI a obținut 0,26%. Claude Opus 4.6 de la Anthropic a reușit 0,25%, în timp ce Grok-4.20 de la xAI a înregistrat exact zero. Între timp, oamenii au rezolvat 100% din medii.

Acesta nu este un test de trivia sau un examen de codare, și nici măcar întrebări ultra-dificile la nivel de doctorat. ARC-AGI-3 este ceva complet diferit de tot ceea ce a întâmpinat până acum industria AI.

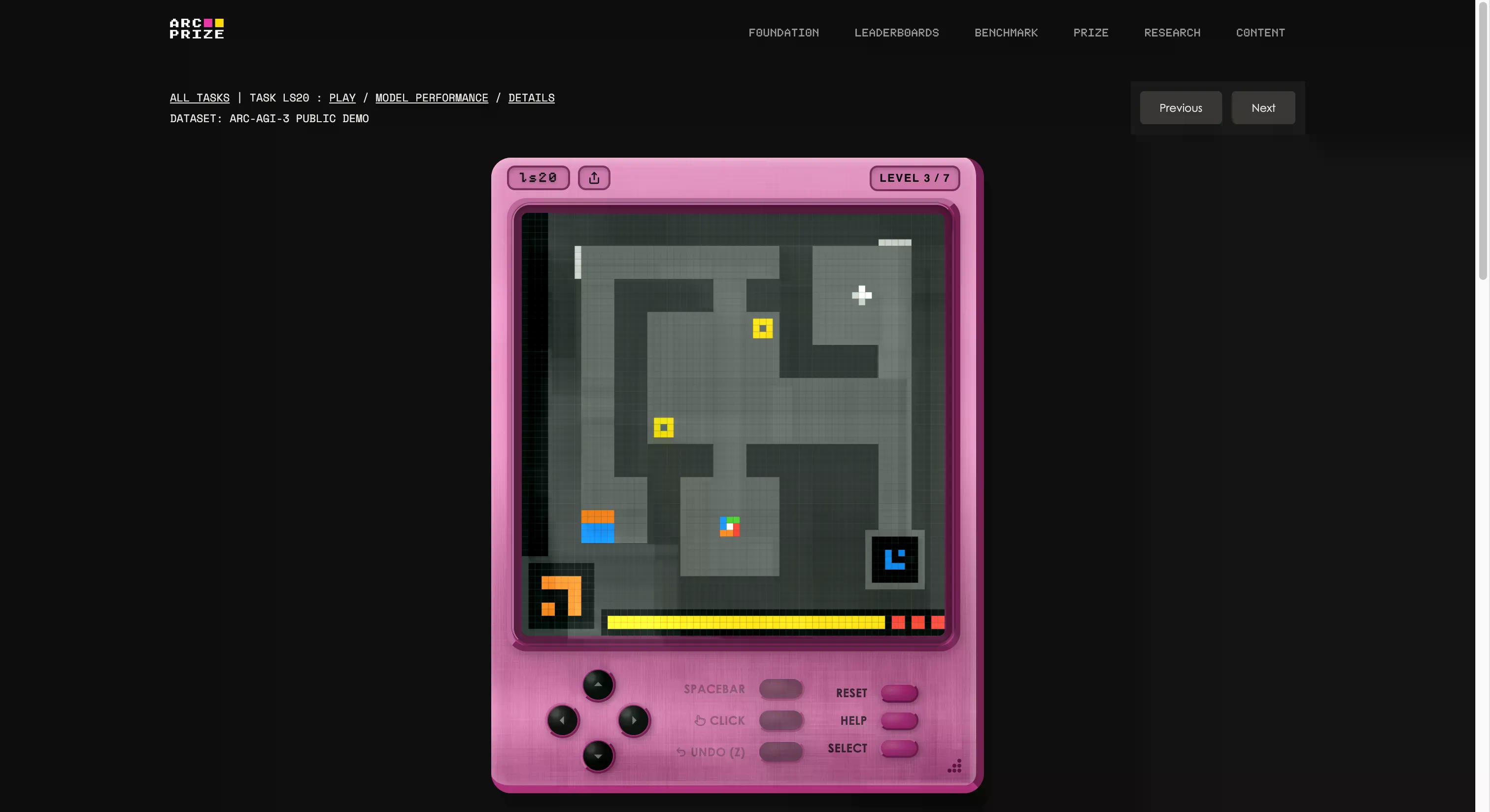

Benchmark-ul a fost construit de fundația lui François Chollet și Mike Knoop, care a înființat un studio de jocuri intern și a creat de la zero 135 de medii interactive originale. Ideea este să plasezi un agent AI într-o lume de joc necunoscută, fără instrucțiuni, fără obiective declarate și fără o descriere a regulilor. Agentul trebuie să exploreze, să-și dea seama ce trebuie să facă, să elaboreze un plan și să-l execute.

Dacă asta sună ca ceva ce orice copil de cinci ani poate face, începeți să înțelegeți problema. Dacă doriți să vedeți dacă sunteți mai bun decât AI, puteți juca aceleași jocuri prezentate în test făcând clic pe acest link. Am încercat unul; a fost ciudat la început, dar după câteva secunde, vă puteți obișnui cu ușurință.

Este, de asemenea, cel mai clar exemplu al semnificației „G” din AGI. Când generalizezi, ești capabil să creezi noi cunoștințe (cum funcționează un joc ciudat) fără să fi fost antrenat în prealabil.

Versiunile anterioare ale ARC au testat puzzle-uri vizuale statice – arată un tipar, prezice-l pe următorul. La început erau dificile. Apoi laboratoarele au alocat putere de calcul și antrenament până când benchmark-urile au fost efectiv „omorâte”. ARC-AGI-1, introdus în 2019, a cedat în fața modelelor de antrenament și raționament în timpul testării. ARC-AGI-2 a rezistat aproximativ un an înainte ca Gemini 3.1 Pro să atingă 77,1%. Laboratoarele sunt foarte bune în a satura benchmark-urile împotriva cărora pot antrena.

Versiunea 3 a fost concepută special pentru a preveni acest lucru. Cu 110 din cele 135 de medii păstrate private – 55 semi-private pentru testarea API, 55 complet blocate pentru competiție – nu există un set de date de memorat. Nu poți forța o soluție pentru o logică de joc inedită pe care nu ai mai văzut-o niciodată.

Scorurile nu sunt nici de tipul „admis/respins”. ARC-AGI-3 utilizează ceea ce fundația numește RHAE – Eficiența Relativă a Acțiunii Umane. Linia de bază este a doua cea mai bună performanță umană la prima încercare. Un AI care efectuează de zece ori mai multe acțiuni decât un om obține 1% pentru acel nivel, nu 10%. Formula aplică un pătrat penalizării pentru ineficiență. Rătăcirile, revenirea asupra pașilor și ghicitul soluției sunt aspru pedepsite.

Cel mai bun agent AI din previzualizarea de o lună pentru dezvoltatori a obținut 12,58%. Modelele LLM de frontieră testate prin API-ul oficial, fără instrumente personalizate, nu au reușit să depășească 1%. Oamenii obișnuiți au rezolvat toate cele 135 de medii fără antrenament prealabil și fără instrucțiuni. Dacă acesta este standardul, atunci generația actuală de modele nu-l atinge.

Există o singură dezbatere metodologică reală aici. Raportul ARC afirmă că un sistem personalizat construit la Duke a împins Claude Opus 4.6 de la 0,25% la 97,1% pe o singură variantă de mediu numită TR87. Aceasta nu înseamnă că Claude a obținut 97,1% la ARC-AGI-3 în ansamblu; scorul său oficial de benchmark a rămas 0,25%, dar schimbarea merită totuși notată.

Benchmark-ul oficial alimentează agenții cu cod JSON, nu cu elemente vizuale. Aceasta este fie o deficiență metodologică, fie o demonstrație că modelele de astăzi sunt mai bune la procesarea informațiilor prietenoase cu omul decât a datelor structurate brute. Fundația lui Chollet a recunoscut dezbaterea, dar nu modifică formatul.

„Percepția conținutului cadru și formatul API nu sunt factori limitativi pentru performanța modelelor de frontieră pe ARC-AGI-3”, se arată în lucrare. Cu alte cuvinte, ei par să respingă ideea că modelele eșuează pentru că „nu pot vedea” sarcinile corect, argumentând în schimb că percepția este deja suficientă – iar decalajul real constă în raționament și generalizare.

Verificarea realității privind AGI a sosit într-o săptămână în care mașina de hype rula la turație maximă. Pe lângă comentariul lui Huang, Arm și-a denumit noul cip pentru centre de date „AGI CPU”. Sam Altman de la OpenAI a declarat că „au construit practic AGI”, iar Microsoft comercializează deja un laborator axat pe construirea ASI: o evoluție a ceea ce urmează după atingerea AGI. Termenul este extins până când înseamnă orice este convenabil din punct de vedere comercial, se pare.

Poziția lui Chollet este mai simplă. Dacă un om obișnuit, fără instrucțiuni, o poate face, iar sistemul tău nu, atunci nu ai AGI – ai un autocomplet foarte scump care are nevoie de mult ajutor.

ARC Prize 2026 oferă 2 milioane de dolari pe trei piste de competiție, toate găzduite pe Kaggle. Fiecare soluție câștigătoare trebuie să fie open-source. Timpul curge, iar în acest moment, mașinile nu sunt nici pe departe aproape.